## 把分类网络修改为语义分割的网络存在下面问题:

1. 分辨率变小(the reduction of signal

resolution incurred by the repeated combination of max-pooling and downsampling (‘striding’) performed at every layer of standard DCNNs)

2. spatial ‘insensitivity’ (invariance)。(relates to the fact that obtaining object-centric decisions from a classifier requires invariance to spatial transformations, inherently limiting the spatial accuracy of the DCNN

model)-- This is

due to the very invariance properties that make DCNNs good for high level tasks

*****

我们来看FCN怎么来解决这两个问题的?

### 第一个问题解决思路:

2014年,加州大学伯克利分校的Long等人提出的**完全卷积网络(Fully Convolutional Networks)**,推广了原有的CNN结构,**在不带有全连接层的情况下能进行密集预测。**然后使用反卷积层来恢复图像的分辨率

这种结构的提出使得分割图谱可以生成任意大小的图像,且与图像块分类方法相比,也提高了处理速度。在后来,几乎所有关于语义分割的最新研究都采用了这种结构。

### 第二个问题解决思路:

使用了skip结构来结合底层特征和高层特征,来提高图像的分割精度

*****

### FCN总览:

论文:

Fully Convolutional Networks for Semantic Segmentation

于2014年11月14日提交到arvix

[https://arxiv.org/abs/1411.4038](http://link.zhihu.com/?target=https%3A//arxiv.org/abs/1411.4038)

主要贡献:

* 将端到端的卷积网络推广到语义分割中;

* 重新将预训练好的Imagenet网络用于分割问题中;

* 使用反卷积层进行上采样;

* 提出了跳跃连接来改善上采样的粗糙程度。

具体解释:

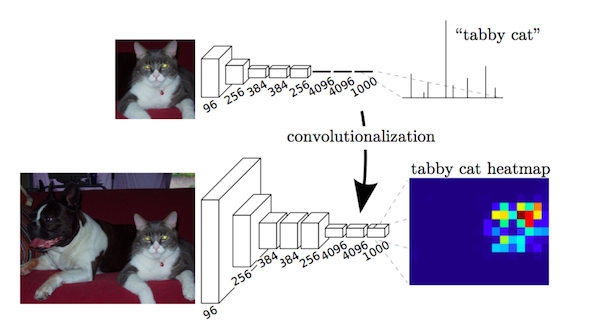

本文的关键在于:分类网络中的全连接层可以看作是使用卷积核遍历整个输入区域的卷积操作。

这相当于在重叠的输入图像块上评估原始的分类网络,但是与先前相比计算效率更高,因为在图像块重叠区域,共享计算结果。

尽管这种方法并不是这篇文章中所特有的,还有一篇关于overfeat的文章也使用了这种思想,但是确实显著提高了在VOC2012数据集上的实际效果。

**△**用卷积运算实现的全连接层结构

在将VGG等预训练网络模型的全连接层卷积化之后,由于CNN网络中的池化操作,得到的特征图谱仍需进行上采样。

反卷积层在进行上采样时,不是使用简单的双线性插值,而是通过学习实现插值操作。此网络层也被称为上卷积、完全卷积、转置卷积或是分形卷积。

然而,由于在池化操作中丢失部分信息,使得即使加上反卷积层的上采样操作也会产生粗糙的分割图。因此,本文还从高分辨率特性图谱中引入了跳跃连接方式。

个人评论:

本文的研究贡献非常重要,但是最新的研究已经很大程度地改进了这个结果。

> 最后我们给出一个对FCN理解我认为很到位的两个连接:https://blog.csdn.net/DL_CreepingBird/article/details/78574059

> https://blog.csdn.net/DL_CreepingBird/article/details/78574059

- 序言

- 第一章 机器学习概述

- 第二章 机器学习环境搭建

- 环境搭建

- 第三章 机器学习之基础算法

- 第一节:基础知识

- 第二节:k近邻算法

- 第三节:决策树算法

- 第四节:朴素贝叶斯

- 第五节:逻辑斯蒂回归

- 第六节:支持向量机

- 第四章 机器学习之深度学习算法

- 第一节: CNN

- 4.1.1 CNN介绍

- 4.1.2 CNN反向传播

- 4.1.3 DNN实例

- 4.1.4 CNN实例

- 第五章 机器学习论文与实践

- 第一节: 语义分割

- 5.1 FCN

- 5.1.1 FCN--------实现FCN16S

- 5.1.2 FCN--------优化FCN16S

- 5.2 DeepLab

- 5.2.1 DeepLabv2

- 第六章 机器学习在实际项目中的应用