> 简介:本文由网易云音乐实时计算平台研发工程师岳猛分享,主要从以下四个部分将为大家介绍 Flink + Kafka 在网易云音乐的应用实战:

>

> 1. 背景

> 2. Flink + Kafka 平台化设计

> 3. Kafka 在实时数仓中的应用

> 4. 问题 & 改进

## 一、背景介绍

### (一)流平台通用框架

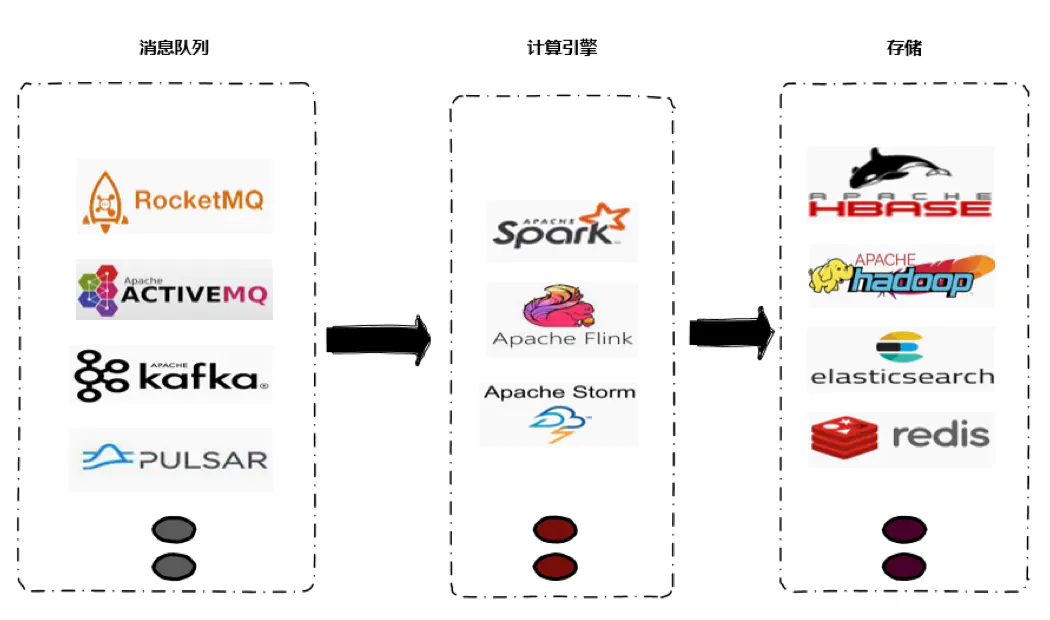

目前流平台通用的架构一般来说包括消息队列、计算引擎和存储三部分,通用架构如下图所示。客户端或者 web 的 log 日志会被采集到消息队列;计算引擎实时计算消息队列的数据;实时计算结果以 Append 或者 Update 的形式存放到实时存储系统中去。

目前,我们常用的消息队列是 Kafka,计算引擎一开始我们采用的是 Spark Streaming,随着 Flink 在流计算引擎的优势越来越明显,我们最终确定了 Flink 作为我们统一的实时计算引擎。

image

### (二)为什么选 Kafka?

Kafka 是一个比较早的消息队列,但是它是一个非常稳定的消息队列,有着众多的用户群体,网易也是其中之一。我们考虑 Kafka 作为我们消息中间件的主要原因如下:

· 高吞吐,低延迟:每秒几十万 QPS 且毫秒级延迟;

· 高并发:支持数千客户端同时读写;

· 容错性,可高性:支持数据备份,允许节点丢失;

· 可扩展性:支持热扩展,不会影响当前线上业务。

### (三)为什么选择 Flink?

Apache Flink 是近年来越来越流行的一款开源大数据流式计算引擎,它同时支持了批处理和流处理,考虑 Flink 作为我们流式计算引擎的主要因素是:

· 高吞吐,低延迟,高性能;

· 高度灵活的流式窗口;

· 状态计算的 Exactly-once 语义;

· 轻量级的容错机制;

· 支持 EventTime 及乱序事件;

· 流批统一引擎。

### (四)Kafka + Flink 流计算体系

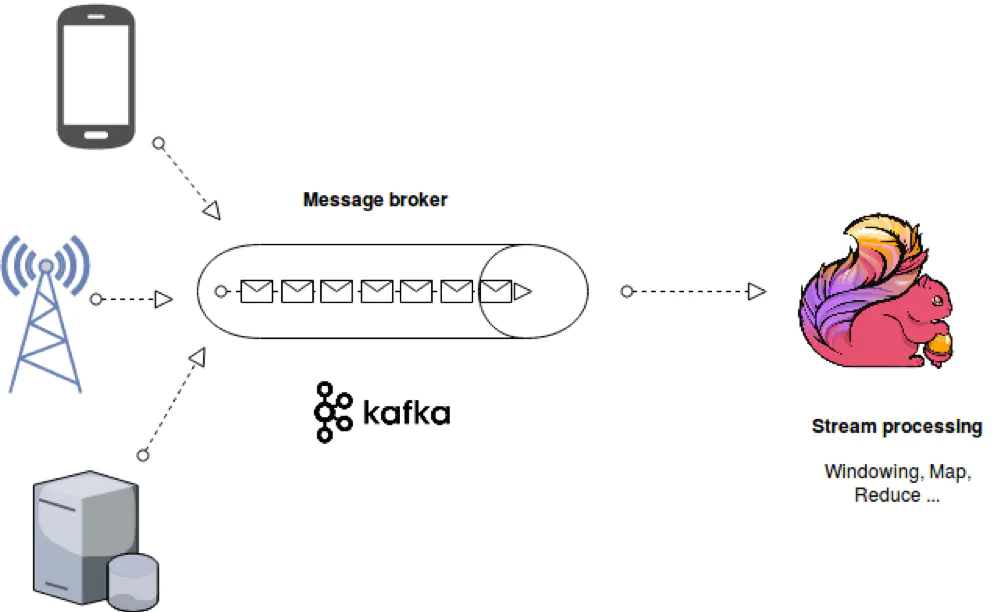

基于 Kafka 和 Flink 的在消息中间件以及流式计算方面的耀眼表现,于是产生了围绕 Kafka 及 Flink 为基础的流计算平台体系,如下图所示:基于 APP、web 等方式将实时产生的日志采集到 Kafka,然后交由 Flink 来进行常见的 ETL,全局聚合以及Window 聚合等实时计算。

image

### (五)网易云音乐使用 Kafka 的现状

目前我们有 10+个 Kafka 集群,各个集群的主要任务不同,有些作为业务集群,有些作为镜像集群,有些作为计算集群等。当前 Kafka 集群的总节点数达到 200+,单 Kafka 峰值 QPS 400W+。目前,网易云音乐基于 Kafka+Flink 的实时任务达到了 500+。

## 二、Flink+Kafka 平台化设计

基于以上情况,我们想要对 Kafka+Flink 做一个平台化的开发,减少用户的开发成本和运维成本。实际上在 2018 年的时候我们就开始基于 Flink 做一个实时计算平台,Kafka 在其中发挥着重要作用,今年,为了让用户更加方便、更加容易的去使用 Flink 和 Kafka,我们进行了重构。

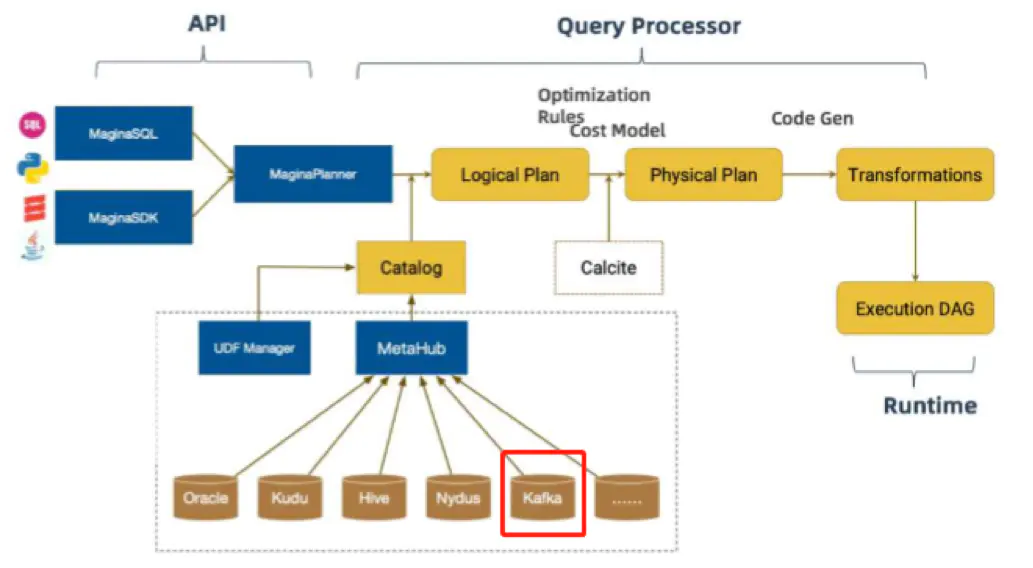

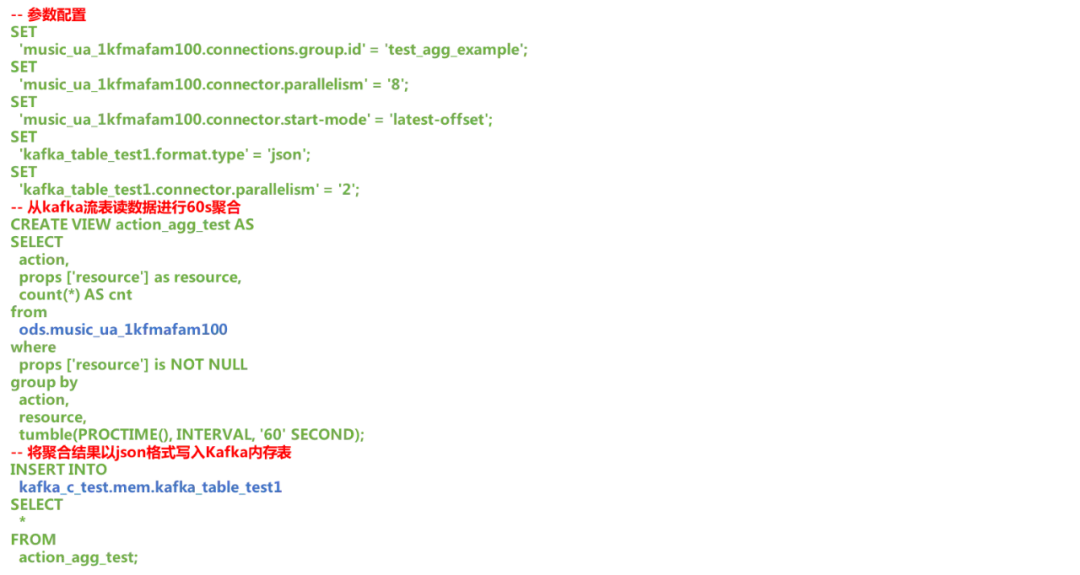

基于 Flink 1.0 版本我们做了一个 Magina 版本的重构,在 API 层次我们提供了 Magina SQL 和 Magina SDK 贯穿 DataStream 和 SQL 操作;然后通过自定义 Magina SQL Parser 会把这些 SQL 转换成 Logical Plan,在将 LogicalPlan 转化为物理执行代码,在这过程中会去通过 catalog 连接元数据管理中心去获取一些元数据的信息。我们在 Kafka 的使用过程中,会将 Kafka 元数据信息登记到元数据中心,对实时数据的访问都是以流表的形式。在 Magina 中我们对 Kafka 的使用主要做了三部分的工作:

· 集群 catalog 化;

· Topic 流表化;

· Message Schema 化。

image

用户可以在元数据管理中心登记不同的表信息或者 catalog 信息等,也可以在 DB 中创建和维护 Kafka 的表,用户在使用的过程只需要根据个人需求使用相应的表即可。下图是对 Kafka 流表的主要引用逻辑。

image

## 三、Kafka 在实时数仓中的应用

## (一)在解决问题中发展

Kafka 在实时数仓使用的过程中,我们遇到了不同的问题,中间也尝试了不同的解决办法。

在平台初期, 最开始用于实时计算的只有两个集群,且有一个采集集群,单 Topic 数据量非常大;不同的实时任务都会消费同一个大数据量的 Topic,Kafka 集群 IO 压力异常大;

因此,在使用的过程发现 Kafka 的压力异常大,经常出现延迟、I/O 飙升。

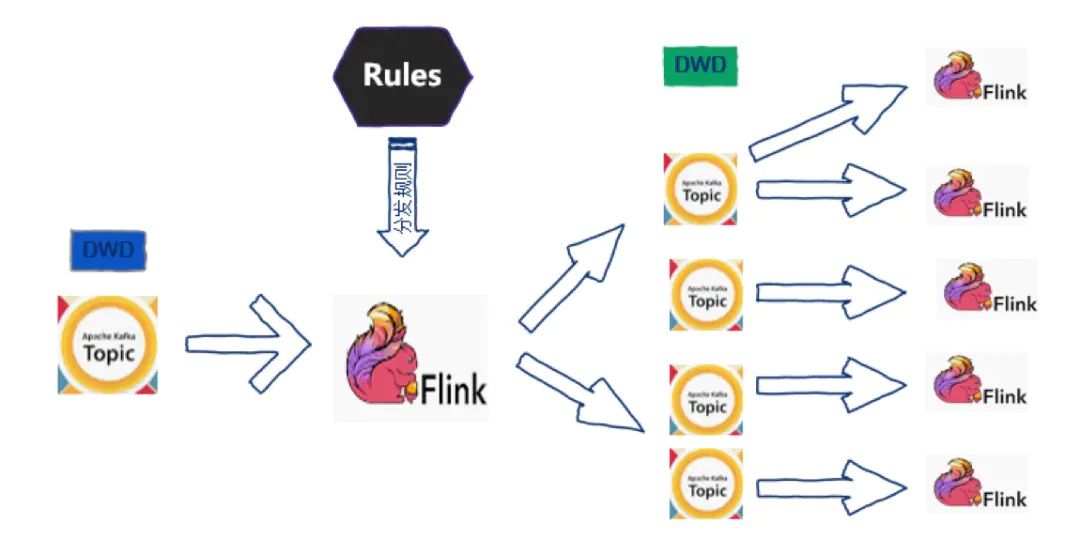

我们想到把大的 Topic 进行实时分发来解决上面的问题,基于 Flink 1.5 设计了如下图所示的数据分发的程序,也就是实时数仓的雏形。基于这种将大的 Topic 分发成小的 Topic 的方法,大大减轻了集群的压力,提升了性能,另外,最初使用的是静态的分发规则,后期需要添加规则的时候要进行任务的重启,对业务影响比较大,之后我们考虑了使用动态规则来完成数据分发的任务。

image

解决了平台初期遇到的问题之后,在平台进阶过程中 Kafka 又面临新的问题:

· 虽然进行了集群的扩展,但是任务量也在增加,Kafka 集群压力仍然不断上升;

· 集群压力上升有时候出现 I/O 相关问题,消费任务之间容易相互影响;

· 用户消费不同的 Topic 过程没有中间数据的落地,容易造成重复消费;

· 任务迁移 Kafka 困难。

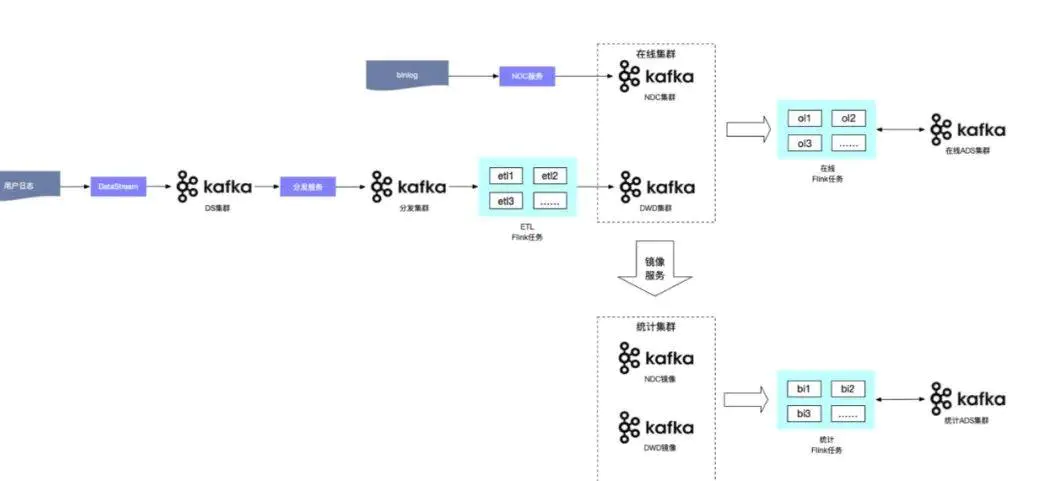

针对以上问题,我们进行了如下图所示的 Kafka 集群隔离和数据分层处理。其过程简单来说,将集群分成 DS 集群、日志采集集群、分发集群,数据通过分发服务分发到 Flink 进行处理,然后通过数据清洗进入到 DW 集群,同时在 DW 写的过程中会同步到镜像集群,在这个过程中也会利用 Flink 进行实时计算的统计和拼接,并将生成的 ADS 数据写入在线 ADS 集群和统计 ADS 集群。通过上面的过程,确保了对实时计算要求比较高的任务不会受到统计报表的影响。

image

通过上面的过程,确保了对实时计算要求比较高的任务不会受到统计报表的影响。但是我们分发了不同的集群以后就不可避免的面临新的问题:

· 如何感知 Kafka 集群状态?

· 如何快速分析 Job 消费异常?

针对上面两个问题,我们做了一个 Kafka 监控系统,其监控分为如下两个维度,这样在出现异常的时候就可以进行具体判断出现问题的详细情况:

· 集群概况的监控:可以看到不同集群对应的 Topic 数量以及运行任务数量,以及每个 Topic 消费任务数据量、数据流入量、流入总量和平均每条数据大小;

· 指标监控:可以看到 Flink 任务以及对应的 Topic、GroupID、所属集群、启动时间、输入带宽、InTPS、OutTPS、消费延迟以及 Lag 情况。

## (二)Flink + Kafka 在 Lambda 架构下的运用

流批统一是目前非常火的概念,很多公司也在考虑这方面的应用,目前常用的架构要么是 Lambda 架构,要么是 Kappa 架构。对于流批统一来讲需要考虑的包括存储统一和计算引擎统一,由于我们当前基建没有统一的存储,那么我们只能选择了 Lamda 架构。

下图是基于 Flink 和 Kafka 的 Lambda 架构在云音乐的具体实践,上层是实时计算,下层是离线计算,横向是按计算引擎来分,纵向是按实时数仓来区分。

image

## 四、问题&改进

在具体的应用过程中,我们也遇到了很多问题,最主要的两个问题是:

· 多 Sink 下 Kafka Source 重复消费问题;

· 同交换机流量激增消费计算延迟问题。

### (一)多 Sink 下 Kafka Source 重复消费问题

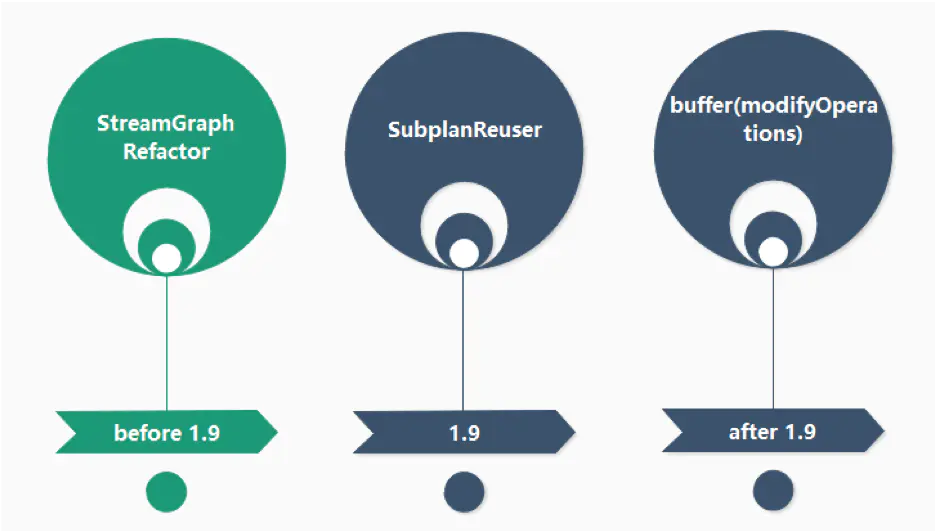

Magina 平台上支持多 Sink,也就是说在操作的过程中可以将中间的任意结果插入到不同的存储中。这个过程中就会出现一个问题,比如同一个中间结果,我们把不同的部分插入到不同的存储中,那么就会有多条 DAG,虽然都是临时结果,但是也会造成 Kafka Source 的重复消费,对性能和资源造成极大的浪费。

于是我们想,是否可以避免临时中间结果的多次消费。在 1.9 版本之前,我们进行了 StreamGraph 的重建,将三个 DataSource 的 DAG 进行了合并;在 1.9 版本,Magina 自己也提供了一个查询和 Source 合并的优化;但是我们发现如果是在同一个 data update 中有对同一个表的多个 Source 的引用,它自己会合并,但是如果不是在同一个 data update 中,是不会立即合并的,于是在 1.9 版本之后中我们对 modifyOperations 做了一个 buffer 来解决这个问题。

image

### (二)同交换机流量激增消费计算延迟问题

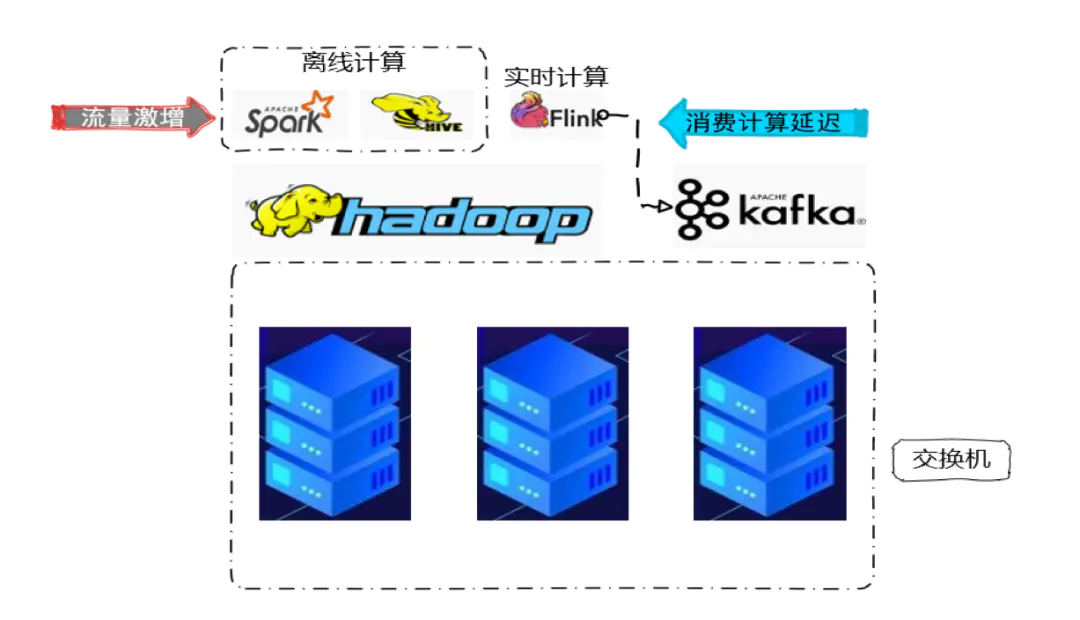

这个问题是最近才出现的问题,也可能不仅仅是同交换机,同机房的情况也可能。在同一个交换机下我们部署了很多机器,一部分机器部署了 Kafka 集群,还有一部分部署了 Hadoop 集群。在 Hadoop 上面我们可能会进行 Spark、Hive 的离线计算以及 Flink 的实时计算,Flink 也会消费 Kafka 进行实时计算。在运行的过程中我们发现某一个任务会出现整体延迟的情况,排查过后没有发现其他的异常,除了交换机在某一个时间点的浏览激增,进一步排查发现是离线计算的浏览激增,又因为同一个交换机的带宽限制,影响到了 Flink 的实时计算。

image

为解决这个问题,我们就考虑要避免离线集群和实时集群的相互影响,去做交换机部署或者机器部署的优化,比如离线集群单独使用一个交换机,Kafka 和 Flink 集群也单独使用一个交换机,从硬件层面保证两者之间不会相互影响。

## 五、Q & A

**Q1:Kafka 在实时数仓中的数据可靠吗?**

A1:这个问题的答案更多取决于对数据准确性的定义,不同的标准可能得到不同的答案。自己首先要定义好数据在什么情况下是可靠的,另外要在处理过程中有一个很好的容错机制。

**Q2:我们在学习的时候如何去学习这些企业中遇到的问题?如何去积累这些问题?**

A2:个人认为学习的过程是问题推动,遇到了问题去思考解决它,在解决的过程中去积累经验和自己的不足之处。

**Q3:你们在处理 Kafka 的过程中,异常的数据怎么处理,有检测机制吗?**

A3:在运行的过程中我们有一个分发的服务,在分发的过程中我们会根据一定的规则来检测哪些数据是异常的,哪些是正常的,然后将异常的数据单独分发到一个异常的 Topic 中去做查询等,后期用户在使用的过程中可以根据相关指标和关键词到异常的 Topic 中去查看这些数据。

10人点赞

[Apache Flink](/nb/37017347)

Flink中文社区

- php开发

- 常用技巧

- 字符数组对象

- php换行替换,PHP替换回车换行符的三种方法

- PHP 数组转字符串,与字符串转数组

- php将img中的宽高删除,PHP删除HTML中宽高样式的详解

- php去除换行(回车换行)的三种方法

- php 过滤word 样式

- php如何设置随机数

- 2个比较经典的PHP加密解密函数分享

- php怎么去除小数点后多余的0

- php中判断是一维数组还是二维数组的解决方案

- php 获取数组中出现次数最多的值(重复最多的值)与出现的次数

- PHP过滤掉换行符、特殊空格、制表符等

- PHP中json_endoce转义反斜杠的问题

- PHP过滤Emoji表情和特殊符号的方法

- PHP完美的提取链接正则

- php很牛的图片采集

- 日期处理

- php 获取今日、昨日、上周、本月的起始时间戳和结束时间戳的方法非常简单

- PHP指定时间戳/日期加一天,一年,一周,一月

- 使用php 获取时间今天明天昨天时间戳的详解

- php获得当月的节假日函数(包含周末,年度节假日)

- PHP获取本月起始和截止时间戳

- php 获取每月开始结束时间,php 获取指定月份的开始结束时间戳

- PHP获取今天,昨天,本月,上个月,本年 起始时间戳

- php、mysql查询当天,本周,本月的用法

- php获取两个时间戳之间相隔多少天多少小时多少分多少秒

- 毫秒级时间戳和日期格式转换

- php-倒计时

- 请求提交上传

- php+put+post,Curl和PHP-如何通过PUT,POST,GET通过curl传递json

- PHP put提交和获取数据

- PHP curl put方式上传文件

- 数据导入导出

- PHP快速导入大量数据到数据库的方法

- PHP快速导出百万级数据到CSV或者EXCEL文件

- PHP解析大型Excel表格的库:box/spout

- PHP导入(百万级)Excel表格数据

- PHP如何切割excel大文件

- 使用 PHP_XLSXWriter 代替 PHPExcel 10W+ 数据秒级导出

- 安装php扩展XLSXWriter

- 解决php导入excel表格时获取日期变成浮点数的方法

- xml处理

- PHP XML和数组互相转换

- php解析xml字符串

- php 生成vcf通讯录

- 文件操作相关

- php获取文件后缀的9种方法

- PHP判断远程文件是否存在

- PHP获取文件修改时间,访问时间,inode修改时间

- php获取远程文件大小教程

- php 读取文件并以文件方式下载

- php 把数字转化为大写中文

- 请求响应

- PHP 获取当前访问的URL

- 压缩

- php生成zip压缩包

- PHPMailer

- 整理PHPMailer 发送邮件 邮件内容为html 可以添加多个附件等

- 通达oa

- OA管理员密码忘了怎么办,这里教你分分钟搞定…

- 跨域

- php解决多站点跨域

- php设置samesite cookie,有效防止CSRF

- Chrome 配置samesite=none方式

- Cookie 的 SameSite 属性

- 图片

- php pdf首页截图,PHP_PHP中使用Imagick读取pdf并生成png缩略图实例,pdf生成png首页缩略图

- PHP -- 七牛云 在线视频 获取某一帧作为封面图

- PHP图片压缩方法

- 如何解决PHP curl或file_get_contents下载图片损坏或无法打开的问题

- php远程下载文章中图片并保存源文件名不变

- 详解PHP如何下载采集图片到本地(附代码实例)

- php如何将webp格式图片转为jpeg

- PHP获取远程图片的宽高和体积大小

- php 软件版本号比较

- 使用PHP通过SMTP发送电邮

- 常用正则表达式

- php如何用正则表达式匹配中文

- 用于分割字符串的 PHP preg_match_all 正则表达式

- 性能优化

- php.ini配置调优

- PHP 几种常见超时的设置方法

- PHP函数in_array、array_key_exists和isset效率分析

- php array push 和array_merge 效率谁高,php 通过array_merge()和array+array合并数组的区别和效率比较...

- php 两个数组取交集、并集、差集

- 设置PHP最大连接数及php-fpm 高并发 参数调整

- 小工具

- php 获取代码执行时间和消耗的内存

- PHP如何判断某项扩展是否开启

- centos7.x下php 导出扩展 XLSXWriter 安装

- php生成mysql数据库字典

- PHP 实现 word/excel/ppt 转换为 PDF

- composer的使用

- showdoc sqlite3 找回管理员密码

- php怎么将数组转为xml

- PHP抖音最新视频提取代码

- yii

- Yii2 如何获取Header参数?

- swoole

- Linux下搭建swoole服务的基本步骤

- 相关学习资料

- 带你学习swoole_process详解

- 按照官方文档 在win10下安装 docker for windows easyswoole镜像 挂载目录

- php常用框架

- Hyperf

- 常用算法PHP版

- thinkphp6

- TP6 事件绑定、监听、订阅

- Thinkphp 模板中输出HTML的变量

- Thinkphp6(操作SQL数据库)

- thinkphp6 mysql查询语句对于为null和为空字符串给出特定值处理

- Thinkphp 6 - 连接配置多个数据库并实现自由切换(详细过程及实例demo)

- TP框架中的Db::name 和 dB::table 以及 db('') 的区别

- thinkphp6.0模型篇之模型的软删除

- thinkphp6自定义日志驱动,增加显示全部请求信息

- 其他系统

- 微擎数据库字段字典

- Flutter实现微信支付和iOS IAP支付

- Flutter上线项目实战——苹果内购

- PHP接入苹果支付

- 调试

- php如何获取当前脚本所有加载的文件

- php跟踪所有调用方法,日志方法

- 解析phpstorm + xdebug 远程断点调试

- PHP XDEBUG调试 PHPSTORM配置

- 异常处理

- PHP 出现 502 解决方案

- php 语法解析错误 syntax error unexpected namespace T_NAMESPACE

- Composer 安装与使用

- 数据库相关

- php pdo怎么设置utf8

- php 如何根据最新聊天对用户进行排序

- php lic&fpm

- 让php程序在linux后台执行

- PHPcli模式和fpm模式优缺点在哪里?

- 运行模式

- php运行模式之cli模式

- 自己库

- php批量获取所有公众号粉丝openid

- 地图

- php 判断点在多边形内,php百度地图api判断地址是否在多边形区域内

- PHP,Mysql-根据一个给定经纬度的点,进行附近地点查询

- MySQL 根据经纬度查找排序

- PHP+MySQL获取坐标范围内的数据

- 【百度地图】删除指定覆盖物

- 百度地图多点+画连接线+数字标注

- laravel5.8

- laravel5.8(四)引入自定义常量文件及公共函数文件

- Lumen 查询执行SQL

- 使你的 Laravel 项目模块化

- Laravel 多条件 AND , OR条件组合查询

- Laravel 查询 多个or或者and条件

- laravel redis操作大全

- laravel中外部定义whereIn的用法和where中使用in

- lumen5.8

- 创建laravel5.8 lumen前后台api项目--记录请求和响应日志

- Laravel和Lumen开启SQL日志记录

- Laravel 5.8 常用操作(路径+日志+分页+其他操作)

- 升级php7.4 laravel lumen报错Trying to access array offset on value of type null

- Laravel 任务调度(计划任务,定时任务)

- laravel的command定时任务时间的设置

- Laravel任务调度的简单使用

- laravel单数据库执行事务和多数据库执行事务

- laravel中锁以及事务的简单使用

- 申请其他相关

- 小程序地理位置接口申请

- PHP高并发

- php 高并发下 秒杀处理思路

- 记录 PHP高并发 商品秒杀 问题的 Redis解决方案

- thinkphp3.2

- thinkphp3.2 数据库 AND OR连缀使用

- laravel

- laravel的联表查询with方法的使用

- laravel获取请求路由对应的控制器和方法

- Laravel 模型关联建立与查询

- Laravel多表(3张表以上)with[]关联查询,对关联的模型做条件查询(has,跟join一样结果 )

- Laravel模型属性的隐藏属性、显示属性和临时暴露隐藏属性用法介绍

- aravel获取当前的url以及当前的基础域名方法汇总

- Laravel 模型实现多库查询或者多表映射

- 关于 Laravel 的 with 多表查询问题

- Laravel 模型过滤(Filter)设计

- 懒加载、预加载、with()、load() 傻傻分不清楚?

- laravel模型$castsl属性

- Laravel Query Builder 复杂查询案例:子查询实现分区查询 partition by

- Laravel 模型关联、关联查询、预加载使用实例

- laravel 中with关联查询限定查询字段

- laravel 原生字段查询 whereRaw 和 where(DB::raw(''))

- lavarel - where条件分组查询(orWhere)

- 通过 Laravel 查询构建器实现复杂的查询语句

- 两个结果集合并成一个

- Laravel 对某一列进行筛选然后求和 sum()

- laravel怎么优雅的拼接where,处理whereIn与where数组查询的问题

- laravel查询时判断是否存在数据

- laravel中的whereNull和whereNotNull

- laravel框架中的子查询

- Laravel框架中 orwhere 多条件查询的使用

- Laravel中where的高级使用方法

- laravel复杂的数据库查询(事例)

- laravel多条件查询方法(and,or嵌套查询)

- Laravel 的 where or 查询

- Laravel 进行where 多个or和and的条件查询可用

- 数据库

- mysql

- mysql联合索引(复合索引)详解

- MYSQL 清空表和截断表

- MySQL快速生成大量测试数据(100万、1000万、1亿)

- 提高mysql千万级大数据SQL查询优化30条经验(Mysql索引优化注意)

- MySQL常用命令

- MySQL(三)|《千万级大数据查询优化》第一篇:创建高性能的索引

- MySQL(一)|性能分析方法、SQL性能优化和MySQL内部配置优化

- MySQL(二)|深入理解MySQL的四种隔离级别及加锁实现原理

- MySQL(四)|《千万级大数据查询优化》第一篇:创建高性能的索引(补充)

- MySQL(五)|《千万级大数据查询优化》第二篇:查询性能优化(1)

- MySQL(六)|《千万级大数据查询优化》第二篇:查询性能优化(2)

- MySQL(七)|MySQL分库分表的那点事

- Mysql索引优化 Mysql通过索引提升查询效率(第二棒)

- MySQL查询的性能优化(查询缓存、排序跟索引)

- 【总结】MySQL数据库

- MySQL存储引擎、事务日志并发访问以及隔离级别

- 技巧

- 数据库 SQL查询重复记录 方法

- 替换数据库中某个字段中的部分字符

- mysql开启bin log 并查看bin log日志(linux)

- 分表分区

- 千万级别数据的mysql数据表优化

- MYSQL百万级数据,如何优化

- MySQL备份和恢复

- MySQL间隙锁死锁问题

- 小技巧

- 基础

- MySQL中sql_mode参数

- mysql数据库异常

- this is incompatible with sql_mode=only_full_group_by

- mysql安全

- MySQL数据库被比特币勒索及安全调整

- MongoDB

- sql查询

- MYSQL按时间段分组查询当天,每小时,15分钟数据分组

- 高级

- 基于 MySQL + Tablestore 分层存储架构的大规模订单系统实践-架构篇

- 数据库安全

- 服务器被黑,MySQL 数据库遭比特币勒索!该如何恢复?

- 数千台MySQL数据库遭黑客比特币勒索,该怎么破?

- MySQL 数据库规范

- MySQL数据库开发的36条铁律

- Elasticsearch

- 安装与配置

- ElasticSearch关闭重启命令

- 设置ES默认分词器IK analyzer

- 查询

- elasticsearch 模糊查询不分词,实现 mysql like

- elasticSearch多条件高级检索语句,包含多个must、must_not、should嵌套示例,并考虑nested对象的特殊检索

- elasticSearch按字段普通检索,结果高亮

- Elasticsearch 如何实现查询/聚合不区分大小写?

- 索引更新&刷新

- refresh与批量操作的效率

- Elasticsearch 删除type

- 分词器

- ElasticSearch最全分词器比较及使用方法

- 异常错误

- 解决ES因内存不足而无法查询的错误,Data too large, data for [<http_request>]

- linux

- 基本知识

- CentOS7.5 通过wget下载文件到指定目录

- 【CentOS】vi命令

- centos7查看硬盘使用情况

- CentOS7 查看目录大小

- Centos 7下查看当前目录大小及文件个数

- 普通用户sudo\su 到root免密码

- 普通用户切换到root用户下的免密配置方法

- linux 获取进程启动参数,linux查看进程启动及运行时间

- Linux 查看进程

- linux删除文件后不释放磁盘的问题

- Linux查找大文件命令

- linux 如何关闭正在执行的php脚本

- linux三剑客(grep、sed、awk)基本使用

- centos 卸载软件

- centos查看内存、cpu占用、占用前10,前X

- Centos 查看系统状态

- 异常

- 问题解决:Failed to download metadata for repo ‘appstream‘: Cannot prepare internal mirrorlist:...

- php相关

- centos 安装phpize

- Centos7.2下phpize安装php扩展

- 切换版本

- 运营工具

- 资深Linux运维工程师常用的10款软件/工具介绍

- 一款良心的终端连接工具

- 六款Linux常用远程连接工具介绍,看看哪一款最适合你

- Finalshell

- Linux Finalshell连接centos7和文件无显示问题

- WSL2:我在原生的Win10玩转Linux系统

- MobaXterm

- 运维

- linux服务器上定时自动备份数据库,并保留最新5天的数据

- Centos系统开启及关闭端口

- CentOS7开放和关闭端口命令

- Linux中查看所有正在运行的进程

- 防火墙firewall-cmd命令详解

- centos 7.8阿里云服务器挂载 数据盘

- Linux Finalshell连接centos7和文件无显示问题

- Centos7系统端口被占用问题的解决方法

- vi

- 如何在Vim/Vi中复制,剪切和粘贴

- 命令

- [Linux kill进程] kill 进程pid的使用详解

- 备份还原

- Linux的几种备份、恢复系统方式

- Linux系统全盘备份方法

- 相关软件安装

- linux下 lua安装

- python

- 升级pip之后出现sys.stderr.write(f“ERROR: {exc}“)

- lua

- centos源码部署lua-5.3

- deepin

- deepin20.6设置默认的root密码

- 任务相关

- 宝塔定时任务按秒执行

- CentOS 7 定时任务 crontab 入门

- centos7定时任务crontab

- Linux下定时任务的查看及取消

- Linux(CentOS7)定时执行任务Crond详细说明

- Linux 查看所有定时任务

- linux查看所有用户定时任务

- Linux 定时任务(超详细)

- 防火墙

- Centos7开启防火墙及特定端口

- CentOS防火墙操作:开启端口、开启、关闭、配置

- 生成 SSH 密钥(windows+liunx)

- 阿里云,挂载云盘

- 前端

- layui

- layui多文件上传

- layer.msg()弹框,弹框后继续运行

- radio取值

- layui-数据表格排序

- Layui select选择框添加搜索选项功能

- 保持原来样式

- layui表格单元如何自动换行

- layui-laydate时间日历控件使用方法详解

- layui定时刷新数据表格

- layer 延时设置

- layer.open 回调函数

- 【Layui内置方法】layer.msg延时关闭msg对话框(代码案例)

- layui多图上传图片顺序错乱及重复上传解决

- layer.confirm关闭弹窗

- vue

- Vue跨域解决方法

- vue 4.xx.xx版本降级至2.9.6

- vue-cli 2.x升级到3.x版本, 和3.x降级到2.x版本命令

- 最新版Vue或者指定版本

- Vue2.6.11按需模块安装配置

- jQuery

- jQuery在页面加载时动态修改图片尺寸的方法

- jquery操作select(取值,设置选中)

- 日历

- FullCalendar中文文档:Event日程事件

- js

- JS 之 重定向

- javascript截取video视频第一帧作为封面方案

- HTML <video> preload 属性

- jQuery使用ajax提交post数据

- JS截取视频靓丽的帧作为封面

- H5案例分享:移动端touch事件判断滑屏手势的方向

- JS快速获取图片宽高的方法

- win

- Windows环境下curl的使用

- Cygwin

- Windows下安装Cygwin及apt-cyg

- Cygwin 安装、CMake 安装

- mklink命令 详细使用

- Nginx

- Nginx高级篇-性能优化

- Nginx常用命令(Linux)

- linux+docker+nginx如何配置环境并配置域名访问

- Nginx的启动(start),停止(stop)命令

- linux 查看nginx 安装路径

- 安装配置

- Linux 查看 nginx 安装目录和配置文件路径

- 【NGINX入门】3.Nginx的缓存服务器proxy_cache配置

- thinkphp6.0 伪静态失效404(win下)

- 深入

- nginx rewrite及多upstream

- Nginx负载均衡(upstream)

- 专业术语

- 耦合?依赖?耦合和依赖的关系?耦合就是依赖

- PHP常用六大设计模式

- 高可用

- 分布式与集群

- Nginx 实践案例:反向代理单台web;反向代理多组web并实现负载均衡

- 容器

- Docker

- 30 分钟快速入门 Docker 教程

- linux查看正在运行的容器,说说Docker 容器常用命令

- Windows 安装Docker至D盘

- 配置

- win10 快速搭建 lnmp+swoole 环境 ,部署laravel6 与 swoole框架laravel-s项目1

- win10 快速搭建 lnmp+swoole 环境 ,部署laravel6 与 swoole框架laravel-s项目2

- docker 容器重命名

- Linux docker常用命令

- 使用

- docker 搭建php 开发环境 添加扩展redis、swoole、xdebug

- docker 单机部署redis集群

- Docker 退出容器不停止容器运行 并重新进入正在运行的容器

- 进入退出docker容器

- Docker的容器设置随Docker的启动而启动

- 使用异常处理

- docker容器中bash: vi: command not found

- OCI runtime exec failed: exec failed:解决方法

- docker启动容器慢,很慢,特别慢的坑

- 解决windows docker开发thinkphp6启动慢的问题

- 【Windows Docker】docker挂载解决IO速度慢的问题

- Docker的网络配置,导致Docker使用网路很慢的问题及解决办法

- golang工程部署到docker容器

- Docker 容器设置自启动

- 如何优雅地删除Docker镜像和容器(超详细)

- 5 个好用的 Docker 图形化管理工具

- Docker 可能会用到的命令

- Kubernetes

- 消息队列

- RabbitMQ

- php7.3安装使用rabbitMq

- Windows环境PHP如何使用RabbitMQ

- RabbitMQ学习笔记:4369、5672、15672、25672默认端口号修改

- Window10 系统 RabbitMQ的安装和简单使用

- RabbitMQ默认端口

- RabbitMQ可视化界面登录不了解决方案

- RocketMQ

- Kafka

- ActiveMQ

- mqtt

- phpMQTT详解以及处理使用过程中内存耗死问题

- MQTT--物联网(IoT)消息推送协议

- php实现mqtt发布/发送 消息到主题

- Mqtt.js 的WSS链接

- emqx

- 如何在 PHP 项目中使用 MQTT

- emqx 修改dashboard 密码

- 其他

- Windows 系统中单机最大TCP的连接数详解

- EMQX

- Linux系统EMQX设置开机自启

- Centos7 EMQX部署

- docker安装 EMQX 免费版 docker安装并配置持久化到服务器

- 实时数仓

- 网易云音乐基于 Flink + Kafka 的实时数仓建设实践

- 实时数仓-基于Flink1.11的SQL构建实时数仓探索实践

- 安全

- 网站如何保护用户的密码

- 关于web项目sessionID欺骗的问题

- php的sessionid可以伪造,不要用来做防刷新处理了

- DVWA-Weak Session IDs (弱会话)漏洞利用方式

- 保证接口数据安全的10种方案

- cookie和session的窃取

- 万能密码漏洞

- 黑客如何快速查找网站后台地址方法整理

- 网站后台万能密码/10大常用弱口令

- 万能密码漏洞02

- 大多数网站后台管理的几个常见的安全问题注意防范

- token可以被窃取吗_盗取token

- token被劫持[token被劫持如何保证接口安全性]

- PHP给后台管理系统加安全防护机制的一些方案

- php - 重新生成 session ID

- 隐藏响应中的server和X-Powered-By

- PHP会话控制之如何正确设置session_name

- Session攻击001

- PHP防SQL注入代码,PHP 预防CSRF、XSS、SQL注入攻击

- php25个安全实践

- php架构师 系统管理员必须知道的PHP安全实践

- 版本控制

- Linux服务器关联Git,通过执行更新脚本实现代码同步

- PHP通过exec执行git pull

- git 在linux部署并从windows上提交代码到linux

- git上传到linux服务器,git一键部署代码到远程服务器(linux)

- linux更新git命令,使用Linux定时脚本更新服务器的git代码

- git異常

- 如何解决remote: The project you were looking for could not be found

- git status显示大量文件修改的原因是什么

- PHPstorm批量修改文件换行符CRLF为LF

- git使用

- git常用命令大全

- centos git保存账户密码

- GIT 常用命令

- git怎样还原修改

- Git 如何放弃所有本地修改的方法

- Git忽略文件模式改变

- git: 放弃所有本地修改

- Git三种方法从远程仓库拉取指定的某一个分支

- 杂七杂八

- h5视频

- H5浏览器支持播放格式:H264 AVCA的MP4格式,不能转换为mpeg-4格式,

- iOS无法播放MP4视频文件的解决方案 mp4视频iphone播放不了怎么办

- h5点播播放mp4视频遇到的坑,ios的h5不能播放视频等

- 【Linux 并发请求数】支持多少并发请求数

- Linux下Apache服务器并发优化

- 缓存

- redis

- Linux启动PHP的多进程任务与守护redis队列

- 重启redis命令

- golang