[TOC]

# 导入依赖

~~~

<!-- https://mvnrepository.com/artifact/org.projectlombok/lombok -->

<dependency>

<groupId>org.projectlombok</groupId>

<artifactId>lombok</artifactId>

<version>1.18.10</version>

<scope>provided</scope>

</dependency>

<!-- 添加Junit依赖 -->

<dependency>

<groupId>junit</groupId>

<artifactId>junit</artifactId>

<version>4.12</version>

<scope>test</scope>

</dependency>

<!-- 钱相关 -->

<dependency>

<groupId>org.joda</groupId>

<artifactId>joda-money</artifactId>

<version>1.0.1</version>

</dependency>

<!-- 类型映射相关 -->

<dependency>

<groupId>org.jadira.usertype</groupId>

<artifactId>usertype.core</artifactId>

<version>6.0.1.GA</version>

</dependency>

<!-- https://mvnrepository.com/artifact/mysql/mysql-connector-java -->

<dependency>

<groupId>mysql</groupId>

<artifactId>mysql-connector-java</artifactId>

<!-- <version>5.1.48</version>-->

<version>8.0.18</version>

</dependency>

<!-- 添加hibernate依赖包 -->

<dependency>

<groupId>org.hibernate</groupId>

<artifactId>hibernate-core</artifactId>

<version>5.2.6.Final</version>

</dependency>

~~~

# 配置hibernate.cfg.xml

核心配置文件

位置必须是在src下面

名称: 必须是hibernate.cfg.xml

~~~

<?xml version='1.0' encoding='utf-8'?>

<!DOCTYPE hibernate-configuration PUBLIC

"-//Hibernate/Hibernate Configuration DTD//EN"

"http://www.hibernate.org/dtd/hibernate-configuration-3.0.dtd">

<hibernate-configuration>

<session-factory>

<!-- mysql账户名 -->

<property name="connection.username">root</property>

<!-- mysql密码 -->

<property name="connection.password">root</property>

<!-- mysql驱动 -->

<property name="connection.driver_class">com.mysql.cj.jdbc.Driver</property>

<!-- mysql连接URL -->

<property name="connection.url">jdbc:mysql:///app?useUnicode=true&characterEncoding=UTF-8</property>

<!-- 数据库方言 -->

<property name="dialect">org.hibernate.dialect.MySQLDialect</property>

<!-- 显示sql语句 -->

<property name="show_sql">true</property>

<!-- 格式化sql语句 -->

<property name="format_sql">true</property>

<!-- 根据需要创建数据库 -->

<!--

hbm2ddl.auto的取值

* none : 不用Hibernate自动生成表.

* create : 每次都会创建一个新的表.(测试)

* create-drop : 每次都会创建一个新的表,执行程序结束后删除这个表(测试)

* update : 如果数据库中有表,使用原来的表,如果没有表,创建一个新的表,可以更新表结构

* validate : 只会使用原有的表,对映射关系进行校验

-->

<property name="hbm2ddl.auto">create</property>

</session-factory>

</hibernate-configuration>

~~~

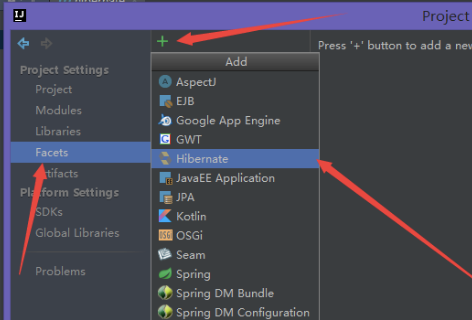

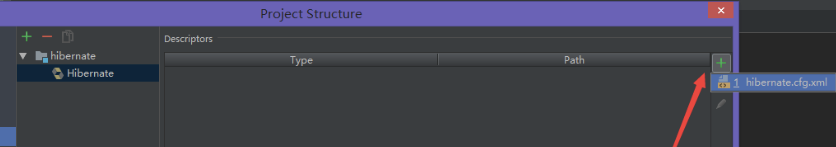

idea添加配置文件

`project structure`->Facets->+号->Hibernate

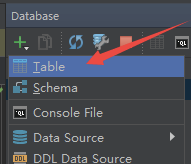

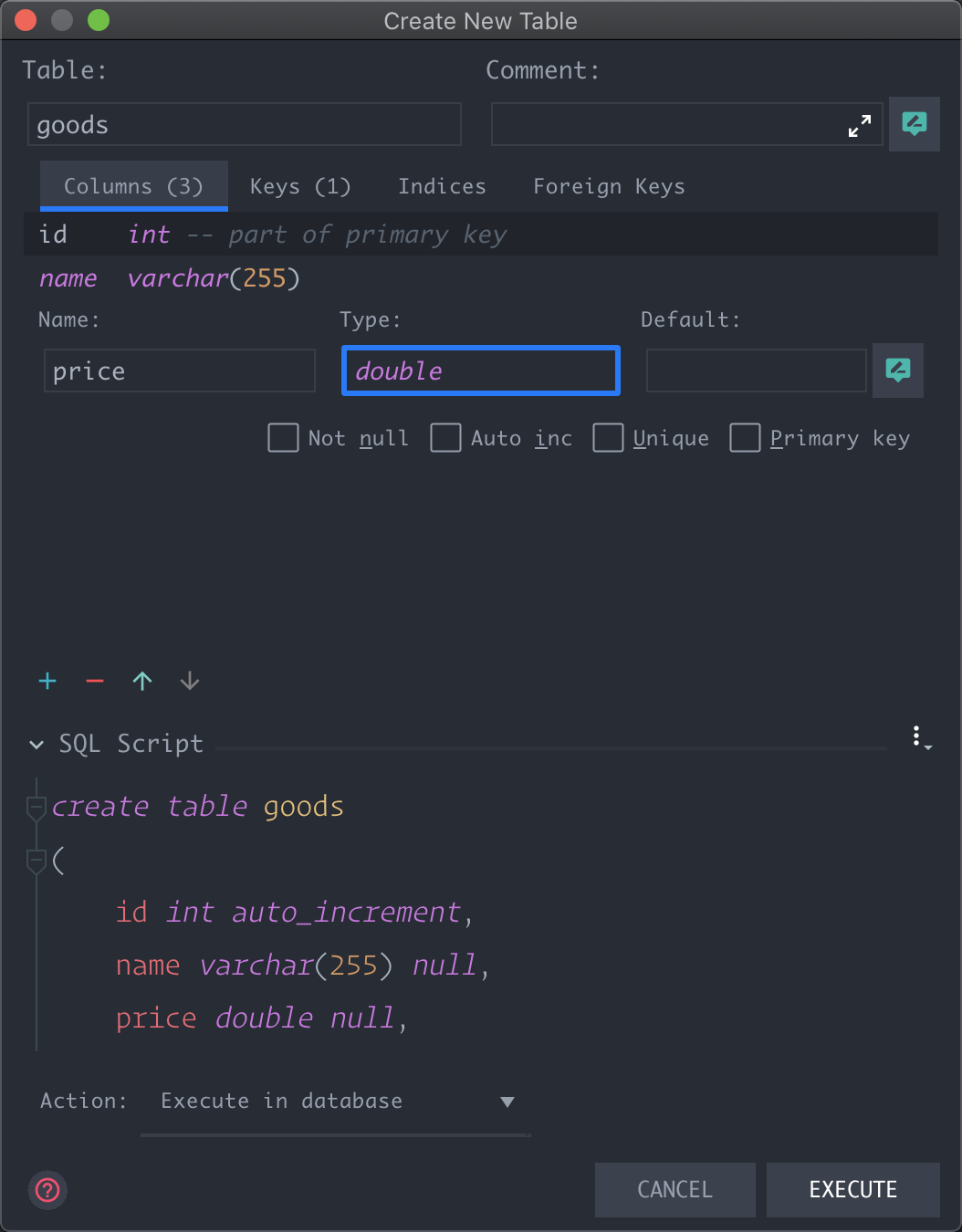

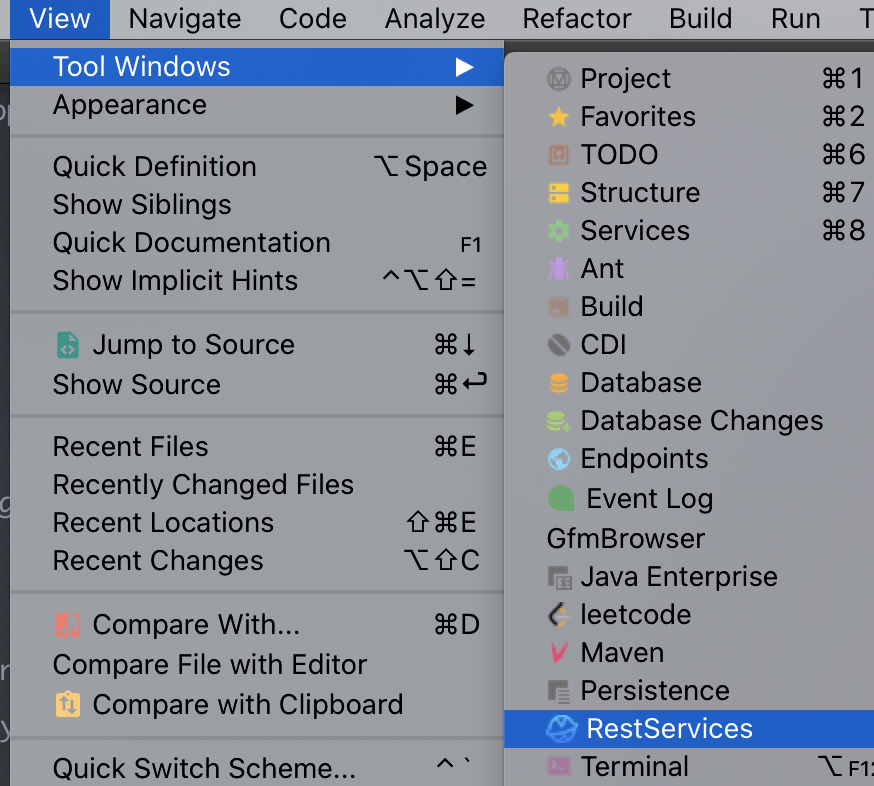

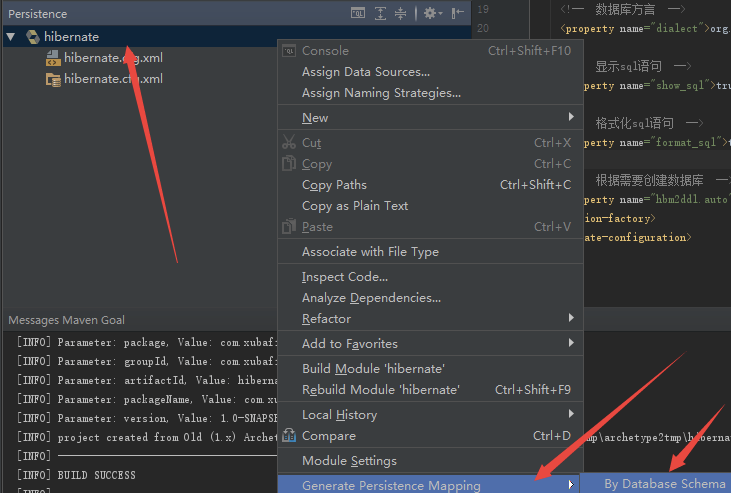

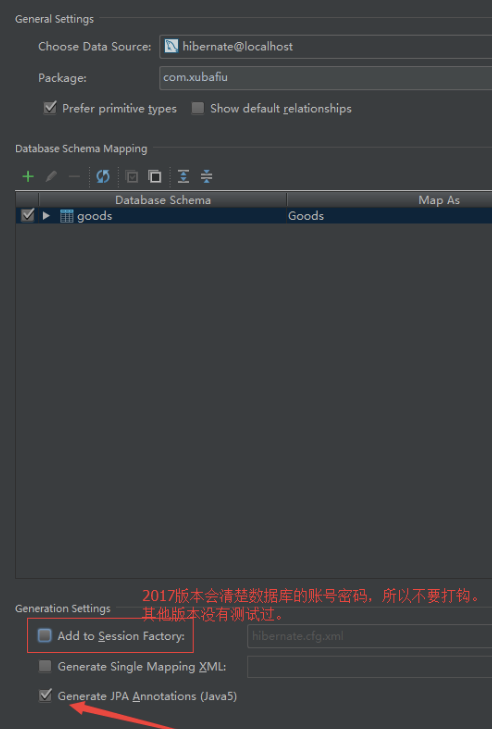

# idea生成

创建goods表

**生成hibernate的数据库映射类**

Choose Data Source选择数据库源

package选择的是放映射类的文件夹

这一步OK之后,查看最终结果

**不过生成的不好,类型应该用包装类型不要用基本类型**

**比如int类型分数,0分和没有考null,用包装类能表示**

**给映射类加一个无参构造方法,有参构造方法可加可不加**

**配置hibernate.cfg.xml,添加刚刚生成的映射类**

~~~

<!-- 格式化sql语句 -->

<property name="format_sql">true</property>

<!-- 根据需要创建数据库 -->

<property name="hbm2ddl.auto">create</property>

<mapping class="com.xubafiu.Goods"></mapping>

</session-factory>

</hibernate-configuration>

~~~

# 测试

~~~

import org.hibernate.Session;

import org.hibernate.SessionFactory;

import org.hibernate.Transaction;

import org.hibernate.cfg.Configuration;

import org.junit.After;

import org.junit.Before;

import org.junit.Test;

public class TestGoods {

private SessionFactory sessionFactory;

private Session session;

private Transaction transaction;

@Before

public void init() {

//创建配置对象,加载核心配置文件,src下的hibernate.cfg.xml,也可以指定位置.configure("/path/xml");

Configuration configuration = new Configuration().configure();

//创建sessionFactory会话工厂

sessionFactory = configuration.buildSessionFactory();

//开启session会话,类似连接

session = sessionFactory.openSession();

//开启事务

transaction = session.beginTransaction();

}

@After

public void destory() {

//事务提交, 事务回滚是transaction.rollback();

transaction.commit();

//关闭session会话

session.close();

//关闭sessionFactory会话工厂

sessionFactory.close();

}

@Test

public void testGoods() {

//生成对象

Goods goods = new Goods(1, "abc", 2333.33);

//保存对象进数据库

session.save(goods);

}

}

~~~

# xml方式

在实体类所在包里面创建,实体名称.hbm.xml

## 映射配置文件

~~~

<?xml version="1.0" encoding="utf-8"?>

<!DOCTYPE hibernate-mapping PUBLIC

"-//Hibernate/Hibernate Mapping DTD 3.0//EN"

"http://hibernate.sourceforge.net/hibernate-mapping-3.0.dtd">

<!-- package属性:填写一个包名.在元素内部凡是需要书写完整类名的属性,可以直接写简答类名了. -->

<!-- <hibernate-mapping package="domain"> -->

<hibernate-mapping>

<!-- 1. 配置类和表对应

class标签

name属性: 实体类全路径

table属性: 数据库表名称

-->

<class name="dao.Goods" table="goods">

<!-- 2. 配置实体类和表id对应

hibernate要求实体类有一个属性唯一值

要求表有字段作为唯一值

-->

<!-- id元素:配置主键映射的属性

name: 填写主键对应属性名

column(可选): 填写表中的主键列名.默认值:列名会默认使用属性名

type(可选):填写列(属性)的类型.hibernate会自动检测实体的属性类型.

每个类型有三种填法: java类型|hibernate类型|数据库类型

not-null(可选):配置该属性(列)是否不能为空. 默认值:false

length(可选):配置数据库中列的长度. 默认值:使用数据库类型的最大长度

-->

<id name="id" column="id">

<!-- 设置数据库表id增长策略, native: 生成表id值就是主键自动增长 -->

<generator class="native" />

</id>

<!-- 配置其他属性和表字段对应 -->

<!-- property元素:除id之外的普通属性映射

name: 填写属性名

column(可选): 填写列名

type(可选):填写列(属性)的类型.hibernate会自动检测实体的属性类型.

每个类型有三种填法: java类型(要写全了java.lang.string)|hibernate类型(string)|数据库类型

not-null(可选):配置该属性(列)是否不能为空. 默认值:false

length(可选):配置数据库中列的长度. 默认值:使用数据库类型的最大长度

-->

<property name="name" column="name" />

<property name="price" column="price" />

</class>

</hibernate-mapping>

~~~

如果用这个的话,核心配置文件要修改

**在核心配置文件中添加**

~~~

<!-- 把映射配置文件放到核心配置文件中 -->

<mapping resource="dao/Goods.hbm.xml" />

</session-factory>

</hibernate-configuration>

~~~

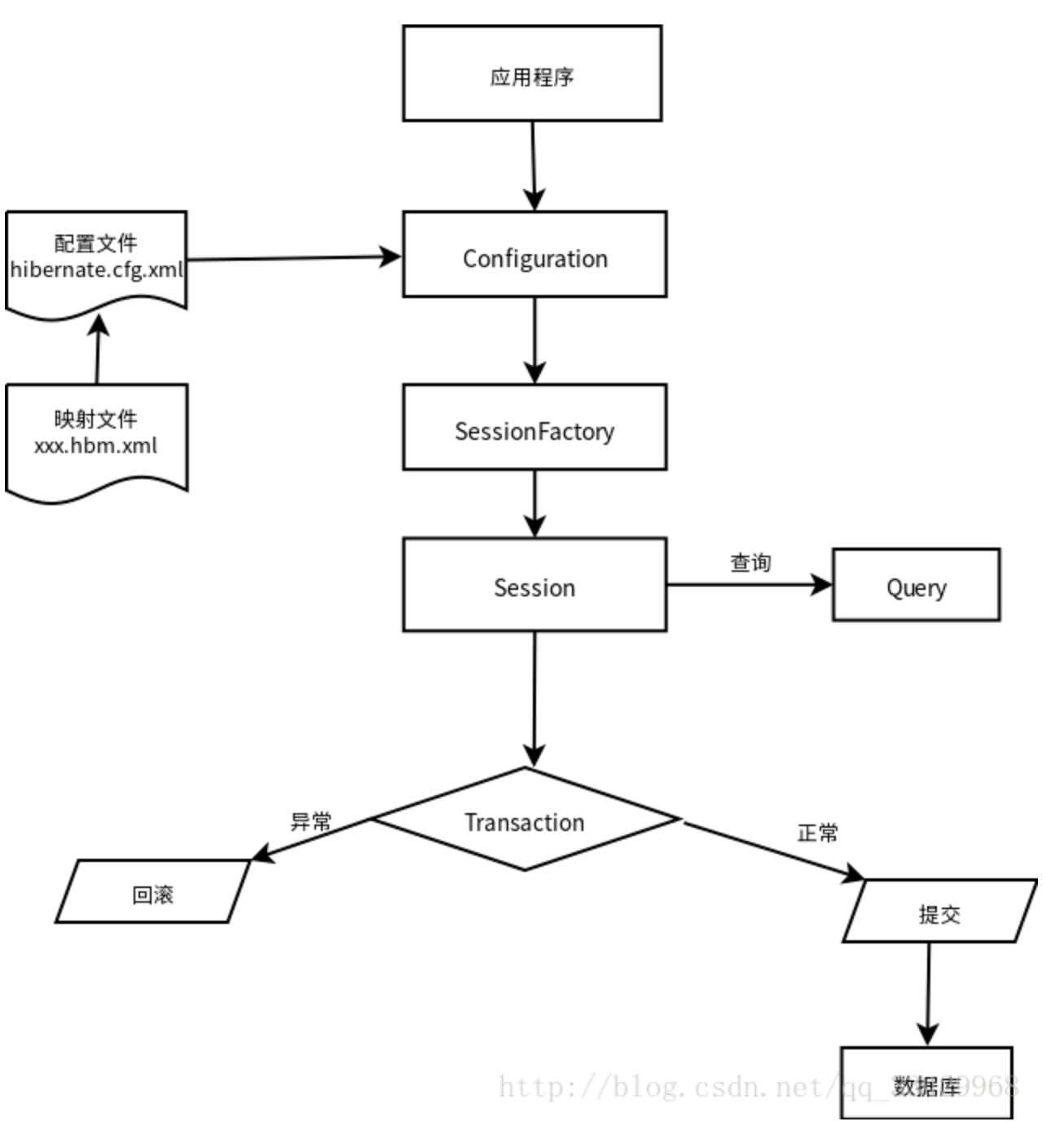

# SessionFactory

1. 使用configuration对象创建sessionFactory对象

根据核心配置文件中,有数据库配置,有映射文件部分,到数据库里面根据映射关系把表创建

~~~

<!-- 根据需要创建数据库 -->

<property name="hbm2ddl.auto">create</property>

~~~

2. 创建sessionFactory过程中,这个过程特别耗资源,一个项目只建议创建一个

# Hibernate执行原理总结

hibernate工作原理:

1. 通过Configuration().configure();读取并解析hibernate.cfg.xml配置文件。

2. 由hibernate.cfg.xml中的读取解析映射信息。

3. 通过config.buildSessionFactory();//得到sessionFactory。

4. sessionFactory.openSession();//得到session。

5. session.beginTransaction();//开启事务。

6. persistent operate;

7. session.getTransaction().commit();//提交事务

8. 关闭session;

9. 关闭sessionFactory;

# session常用方法

~~~

save 保存对象

update 修改操作

delete删除

get/load 根据id进行查询

savenOrUpdate 执行save或update操作

createQuery()获取一个Query对象

CreateSQLQUery()获取一个可以操作sql的SQLQuery对象

createCriteria() 获取一个Criteria它可以完成条件查询

~~~

# Transaction事务

Transaction接口主要用于管理事务,它是hibernate的事务接口,对底层的事务进行了封装。使用它可以进行事务操作。

commit 事务提交

rollback 事务回滚

问题: 获取一个Transaction对象

~~~

Session.beginTransaction();

~~~

问题: 如果在程序中没有开启事务,是否存在事务?

有事务,session的每一个操作就会开启一个事务。

默认不自动提交

~~~

<!-- 用于设置事务提交方式 -->

<property name="hibernate.connection.autocommit">false</property>

~~~

# 什么是持久化类?

Persistent Object (PO)

PO=POJO+hbm映射配置

对于hibernate中的PO编写规则:

1. 必须提供一个无参数的public构造方法

2. 所有属性要private ,对外提供public 的get/set方法

3. 在PO类必须提供一个标识属性,让它与数据库中的主键对应,我们管这个属性叫OID

4. PO类中的属性尽量使用基本数据类型的包装类.

Int->Integer double-->Double float->Float

5. PO类它不能使用final修饰符

# OID作用

~~~

OID指的是与数据库中表的主键对应的属性。

~~~

Hibernate框架它是通过OID来区分不同的PO对象,如果在内存中有两个相同的OID对象,那么hibernate认为它们是同一个对象。

# 为什么PO类属性它要使用包装类型?

使用基本数据类型是没有办法去描述不存在概念,如果使用包装类型,它就是一个对象,对于对象它的默认值是null.

但是基础类型,比如int类型表示分数,没有考应该是null,这个int表示不了

# PO类不可以使用final修饰?(hibernate中的get/load方法的区别)

~~~

Get/load方法它们都是根据id去查询对象。

~~~

1. get直接得到了一个持久化类型对象,它就是立即查询操作

load它得到的是持久化类开的代理类型对象(子类对象)。它采用了一种延迟策略来查询数据。

2. get方法在查询时,如果不存在返回null

load方法在查询时,如果不存在,会产生异常

ObjectNotFoundException.

- 基础

- 编译和安装

- classpath到底是什么?

- 编译运行

- 安装

- sdkman多版本

- jabba多版本

- java字节码查看

- 数据类型

- 简介

- 整形

- char和int

- 变量和常量

- 大数值运算

- 基本类型包装类

- Math类

- 内存划分

- 位运算符

- 方法相关

- 方法重载

- 可变参数

- 方法引用

- 面向对象

- 定义

- 继承和覆盖

- 接口和抽象类

- 接口定义增强

- 内建函数式接口

- 多态

- 泛型

- final和static

- 内部类

- 包

- 修饰符

- 异常

- 枚举类

- 代码块

- 对象克隆

- BeanUtils

- java基础类

- scanner类

- Random类

- System类

- Runtime类

- Comparable接口

- Comparator接口

- MessageFormat类

- NumberFormat

- 数组相关

- 数组

- Arrays

- string相关

- String

- StringBuffer

- StringBuilder

- 正则

- 日期类

- Locale类

- Date

- DateFormat

- SimpleDateFormat

- Calendar

- 新时间日期API

- 简介

- LocalDate,LocalTime,LocalDateTime

- Instant时间点

- 带时区的日期,时间处理

- 时间间隔

- 日期时间校正器

- TimeUnit

- 用yyyy

- 集合

- 集合和迭代器

- ArrayList集合

- List

- Set

- 判断集合唯一

- Map和Entry

- stack类

- Collections集合工具类

- Stream数据流

- foreach不能修改内部元素

- of方法

- IO

- File类

- 字节流stream

- 字符流Reader

- IO流分类

- 转换流

- 缓冲流

- 流的操作规律

- properties

- 序列化流与反序列化流

- 打印流

- System类对IO支持

- commons-IO

- IO流总结

- NIO

- 异步与非阻塞

- IO通信

- Unix的IO模型

- epoll对于文件描述符操作模式

- 用户空间和内核空间

- NIO与普通IO的主要区别

- Paths,Path,Files

- Buffer

- Channel

- Selector

- Pipe

- Charset

- NIO代码

- 多线程

- 创建线程

- 线程常用方法

- 线程池相关

- 线程池概念

- ThreadPoolExecutor

- Runnable和Callable

- 常用的几种线程池

- 线程安全

- 线程同步的几种方法

- synchronized

- 死锁

- lock接口

- ThreadLoad

- ReentrantLock

- 读写锁

- 锁的相关概念

- volatile

- 释放锁和不释放锁的操作

- 等待唤醒机制

- 线程状态

- 守护线程和普通线程

- Lamda表达式

- 反射相关

- 类加载器

- 反射

- 注解

- junit注解

- 动态代理

- 网络编程相关

- 简介

- UDP

- TCP

- 多线程socket上传图片

- NIO

- JDBC相关

- JDBC

- 预处理

- 批处理

- 事务

- properties配置文件

- DBUtils

- DBCP连接池

- C3P0连接池

- 获得MySQL自动生成的主键

- Optional类

- Jigsaw模块化

- 日志相关

- JDK日志

- log4j

- logback

- xml

- tomcat

- maven

- 简介

- 仓库

- 目录结构

- 常用命令

- 生命周期

- idea配置

- jar包冲突

- 依赖范围

- 私服

- 插件

- git-commit-id-plugin

- maven-assembly-plugin

- maven-resources-plugin

- maven-compiler-plugin

- versions-maven-plugin

- maven-source-plugin

- tomcat-maven-plugin

- 多环境

- 自定义插件

- stream

- swing

- json

- jackson

- optional

- junit

- gradle

- servlet

- 配置

- ServletContext

- 生命周期

- HttpServlet

- request

- response

- 乱码

- session和cookie

- cookie

- session

- jsp

- 简介

- 注释

- 方法,成员变量

- 指令

- 动作标签

- 隐式对象

- EL

- JSTL

- javaBean

- listener监听器

- Filter过滤器

- 图片验证码

- HttpUrlConnection

- 国际化

- 文件上传

- 文件下载

- spring

- 简介

- Bean

- 获取和实例化

- 属性注入

- 自动装配

- 继承和依赖

- 作用域

- 使用外部属性文件

- spel

- 前后置处理器

- 生命周期

- 扫描规则

- 整合多个配置文件

- 注解

- 简介

- 注解分层

- 类注入

- 分层和作用域

- 初始化方法和销毁方法

- 属性

- 泛型注入

- Configuration配置文件

- aop

- aop的实现

- 动态代理实现

- cglib代理实现

- aop名词

- 简介

- aop-xml

- aop-注解

- 代理方式选择

- jdbc

- 简介

- JDBCTemplate

- 事务

- 整合

- junit整合

- hibernate

- 简介

- hibernate.properties

- 实体对象三种状态

- 检索方式

- 简介

- 导航对象图检索

- OID检索

- HQL

- Criteria(QBC)

- Query

- 缓存

- 事务管理

- 关系映射

- 注解

- 优化

- MyBatis

- 简介

- 入门程序

- Mapper动态代理开发

- 原始Dao开发

- Mapper接口开发

- SqlMapConfig.xml

- map映射文件

- 输出返回map

- 输入参数

- pojo包装类

- 多个输入参数

- resultMap

- 动态sql

- 关联

- 一对一

- 一对多

- 多对多

- 整合spring

- CURD

- 占位符和sql拼接以及参数处理

- 缓存

- 延迟加载

- 注解开发

- springMVC

- 简介

- RequestMapping

- 参数绑定

- 常用注解

- 响应

- 文件上传

- 异常处理

- 拦截器

- springBoot

- 配置

- 热更新

- java配置

- springboot配置

- yaml语法

- 运行

- Actuator 监控

- 多环境配置切换

- 日志

- 日志简介

- logback和access

- 日志文件配置属性

- 开机自启

- aop

- 整合

- 整合Redis

- 整合Spring Data JPA

- 基本查询

- 复杂查询

- 多数据源的支持

- Repository分析

- JpaSpecificationExecutor

- 整合Junit

- 整合mybatis

- 常用注解

- 基本操作

- 通用mapper

- 动态sql

- 关联映射

- 使用xml

- spring容器

- 整合druid

- 整合邮件

- 整合fastjson

- 整合swagger

- 整合JDBC

- 整合spingboot-cache

- 请求

- restful

- 拦截器

- 常用注解

- 参数校验

- 自定义filter

- websocket

- 响应

- 异常错误处理

- 文件下载

- 常用注解

- 页面

- Thymeleaf组件

- 基本对象

- 内嵌对象

- 上传文件

- 单元测试

- 模拟请求测试

- 集成测试

- 源码解析

- 自动配置原理

- 启动流程分析

- 源码相关链接

- Servlet,Filter,Listener

- springcloud

- 配置

- 父pom

- 创建子工程

- Eureka

- Hystrix

- Ribbon

- Feign

- Zuul

- kotlin

- 基本数据类型

- 函数

- 区间

- 区块链

- 简介

- linux

- ulimit修改

- 防止syn攻击

- centos7部署bbr

- debain9开启bbr

- mysql

- 隔离性

- sql执行加载顺序

- 7种join

- explain

- 索引失效和优化

- 表连接优化

- orderby的filesort问题

- 慢查询

- show profile

- 全局查询日志

- 死锁解决

- sql

- 主从

- IDEA

- mac快捷键

- 美化界面

- 断点调试

- 重构

- springboot-devtools热部署

- IDEA进行JAR打包

- 导入jar包

- ProjectStructure

- toString添加json模板

- 配置maven

- Lombok插件

- rest client

- 文档显示

- sftp文件同步

- 书签

- 代码查看和搜索

- postfix

- live template

- git

- 文件头注释

- JRebel

- 离线模式

- xRebel

- github

- 连接mysql

- 选项没有Java class的解决方法

- 扩展

- 项目配置和web部署

- 前端开发

- json和Inject language

- idea内存和cpu变高

- 相关设置

- 设计模式

- 单例模式

- 简介

- 责任链

- JUC

- 原子类

- 原子类简介

- 基本类型原子类

- 数组类型原子类

- 引用类型原子类

- JVM

- JVM规范内存解析

- 对象的创建和结构

- 垃圾回收

- 内存分配策略

- 备注

- 虚拟机工具

- 内存模型

- 同步八种操作

- 内存区域大小参数设置

- happens-before

- web service

- tomcat

- HTTPS

- nginx

- 变量

- 运算符

- 模块

- Rewrite规则

- Netty

- netty为什么没用AIO

- 基本组件

- 源码解读

- 简单的socket例子

- 准备netty

- netty服务端启动

- 案例一:发送字符串

- 案例二:发送对象

- websocket

- ActiveMQ

- JMS

- 安装

- 生产者-消费者代码

- 整合springboot

- kafka

- 简介

- 安装

- 图形化界面

- 生产过程分析

- 保存消息分析

- 消费过程分析

- 命令行

- 生产者

- 消费者

- 拦截器interceptor

- partition

- kafka为什么快

- kafka streams

- kafka与flume整合

- RabbitMQ

- AMQP

- 整体架构

- RabbitMQ安装

- rpm方式安装

- 命令行和管控页面

- 消息生产与消费

- 整合springboot

- 依赖和配置

- 简单测试

- 多方测试

- 对象支持

- Topic Exchange模式

- Fanout Exchange订阅

- 消息确认

- java client

- RabbitAdmin和RabbitTemplate

- 两者简介

- RabbitmqAdmin

- RabbitTemplate

- SimpleMessageListenerContainer

- MessageListenerAdapter

- MessageConverter

- 详解

- Jackson2JsonMessageConverter

- ContentTypeDelegatingMessageConverter

- lucene

- 简介

- 入门程序

- luke查看索引

- 分析器

- 索引库维护

- elasticsearch

- 配置

- 插件

- head插件

- ik分词插件

- 常用术语

- Mapping映射

- 数据类型

- 属性方法

- Dynamic Mapping

- Index Template 索引模板

- 管理映射

- 建立映射

- 索引操作

- 单模式下CURD

- mget多个文档

- 批量操作

- 版本控制

- 基本查询

- Filter过滤

- 组合查询

- 分析器

- redis

- String

- list

- hash

- set

- sortedset

- 发布订阅

- 事务

- 连接池

- 管道

- 分布式可重入锁

- 配置文件翻译

- 持久化

- RDB

- AOF

- 总结

- Lettuce

- zookeeper

- zookeeper简介

- 集群部署

- Observer模式

- 核心工作机制

- zk命令行操作

- zk客户端API

- 感知服务动态上下线

- 分布式共享锁

- 原理

- zab协议

- 两阶段提交协议

- 三阶段提交协议

- Paxos协议

- ZAB协议

- hadoop

- 简介

- hadoop安装

- 集群安装

- 单机安装

- linux编译hadoop

- 添加新节点

- 退役旧节点

- 集群间数据拷贝

- 归档

- 快照管理

- 回收站

- 检查hdfs健康状态

- 安全模式

- hdfs简介

- hdfs命令行操作

- 常见问题汇总

- hdfs客户端操作

- mapreduce工作机制

- 案例-单词统计

- 局部聚合Combiner

- combiner流程

- combiner案例

- 自定义排序

- 自定义Bean对象

- 排序的分类

- 案例-按总量排序需求

- 一次性完成统计和排序

- 分区

- 分区简介

- 案例-结果分区

- 多表合并

- reducer端合并

- map端合并(分布式缓存)

- 分组

- groupingComparator

- 案例-求topN

- 全局计数器

- 合并小文件

- 小文件的弊端

- CombineTextInputFormat机制

- 自定义InputFormat

- 自定义outputFormat

- 多job串联

- 倒排索引

- 共同好友

- 串联

- 数据压缩

- InputFormat接口实现类

- yarn简介

- 推测执行算法

- 本地提交到yarn

- 框架运算全流程

- 数据倾斜问题

- mapreduce的优化方案

- HA机制

- 优化

- Hive

- 安装

- shell参数

- 数据类型

- 集合类型

- 数据库

- DDL操作

- 创建表

- 修改表

- 分区表

- 分桶表

- DML操作

- load

- insert

- select

- export,import

- Truncate

- 注意

- 严格模式

- 函数

- 内置运算符

- 内置函数

- 自定义函数

- Transfrom实现

- having和where不同

- 压缩

- 存储

- 存储和压缩结合使用

- explain详解

- 调优

- Fetch抓取

- 本地模式

- 表的优化

- GroupBy

- count(Distinct)去重统计

- 行列过滤

- 动态分区调整

- 数据倾斜

- 并行执行

- JVM重用

- 推测执行

- reduce内存和个数

- sql查询结果作为变量(shell)

- youtube

- flume

- 简介

- 安装

- 常用组件

- 拦截器

- 案例

- 监听端口到控制台

- 采集目录到HDFS

- 采集文件到HDFS

- 多个agent串联

- 日志采集和汇总

- 单flume多channel,sink

- 自定义拦截器

- 高可用配置

- 使用注意

- 监控Ganglia

- sqoop

- 安装

- 常用命令

- 数据导入

- 准备数据

- 导入数据到HDFS

- 导入关系表到HIVE

- 导入表数据子集

- 增量导入

- 数据导出

- 打包脚本

- 作业

- 原理

- azkaban

- 简介

- 安装

- 案例

- 简介

- command类型单一job

- command类型多job工作流flow

- HDFS操作任务

- mapreduce任务

- hive脚本任务

- oozie

- 安装

- hbase

- 简介

- 系统架构

- 物理存储

- 寻址机制

- 读写过程

- 安装

- 命令行

- 基本CURD

- java api

- CURD

- CAS

- 过滤器查询

- 建表高级属性

- 与mapreduce结合

- 与sqoop结合

- 协处理器

- 参数配置优化

- 数据备份和恢复

- 节点管理

- 案例-点击流

- 简介

- HUE

- 安装

- storm

- 简介

- 安装

- 集群启动及任务过程分析

- 单词统计

- 单词统计(接入kafka)

- 并行度和分组

- 启动流程分析

- ACK容错机制

- ACK简介

- BaseRichBolt简单使用

- BaseBasicBolt简单使用

- Ack工作机制

- 本地目录树

- zookeeper目录树

- 通信机制

- 案例

- 日志告警

- 工具

- YAPI

- chrome无法手动拖动安装插件

- 时间和空间复杂度

- jenkins

- 定位cpu 100%

- 常用脚本工具

- OOM问题定位

- scala

- 编译

- 基本语法

- 函数

- 数组常用方法

- 集合

- 并行集合

- 类

- 模式匹配

- 异常

- tuple元祖

- actor并发编程

- 柯里化

- 隐式转换

- 泛型

- 迭代器

- 流stream

- 视图view

- 控制抽象

- 注解

- spark

- 企业架构

- 安装

- api开发

- mycat

- Groovy

- 基础