# 十九、张量处理单元

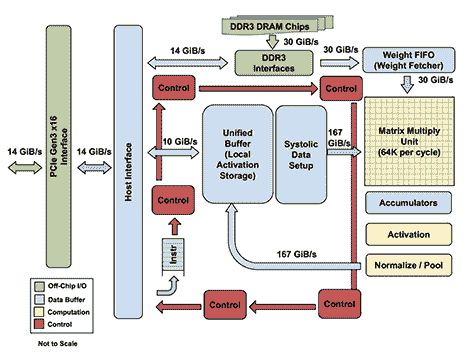

**张量处理单元**(**TPU**)是**专用集成电路**(**ASIC**),它实现了针对计算要求而优化的硬件电路深度神经网络。 TPU 基于**复杂指令集计算机**(**CISC**)指令集,该指令集实现用于训练深度神经网络的复杂任务的高级指令。 TPU 架构的核心在于优化矩阵运算的脉动数组。

The Architecture of TPUImage from: https://cloud.google.com/blog/big-data/2017/05/images/149454602921110/tpu-15.png

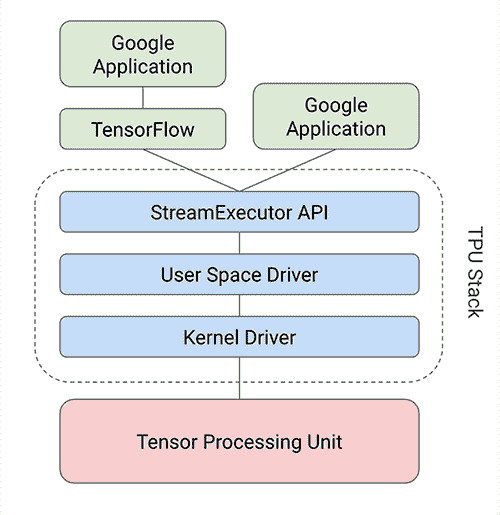

TensorFlow 提供了一个编译器和软件栈,可将 API 调用从 TensorFlow 图转换为 TPU 指令。以下框图描述了在 TPU 栈顶部运行的 TensorFlow 模型的架构:

图像来自[这个链接](https://cloud.google.com/blog/big-data/2017/05/images/149454602921110/tpu-2.png)。TPU 架构的更多信息,阅读[博客](https://cloud.google.com/blog/big-data/2017/05/an-in-depth-look-at-googles-first-tensor-processing-unit-tpu)。

TPU 的 TensorFlow API 位于`tf.contrib.tpu`模块中。为了在 TPU 上构建模型,使用以下三个 TPU 特定的 TensorFlow 模块:

* `tpu_config`:`tpu_config`模块允许您创建配置对象,其中包含有关将运行模型的主机的信息。

* `tpu_estimator`:`tpu_estimator`模块将估计器封装在`TPUEstimatorSpec`类中。要在 TPU 上运行估计器,我们创建此类的对象。

* `tpu_optimizer`:`tpu_optimizer`模块包装优化器。例如,在下面的示例代码中,我们将`tpu_optimizer`类中的 SGD 优化器包装在`tpu_optimizer`类中。

例如,以下代码使用 TFEstimator API 为 TPU 上的 MNIST 数据集构建 CNN 模型:

以下代码改编自[这个页面](https://github.com/tensorflow/tpu-demos/blob/master/cloud_tpu/models/mnist/mnist.py)。

```py

import tensorflow as tf

from tensorflow.contrib.tpu.python.tpu import tpu_config

from tensorflow.contrib.tpu.python.tpu import tpu_estimator

from tensorflow.contrib.tpu.python.tpu import tpu_optimizer

learning_rate = 0.01

batch_size = 128

def metric_fn(labels, logits):

predictions = tf.argmax(logits, 1)

return {

"accuracy": tf.metrics.precision(

labels=labels, predictions=predictions),

}

def model_fn(features, labels, mode):

if mode == tf.estimator.ModeKeys.PREDICT:

raise RuntimeError("mode {} is not supported yet".format(mode))

input_layer = tf.reshape(features, [-1, 28, 28, 1])

conv1 = tf.layers.conv2d(

inputs=input_layer,

filters=32,

kernel_size=[5, 5],

padding="same",

activation=tf.nn.relu)

pool1 = tf.layers.max_pooling2d(inputs=conv1, pool_size=[2, 2],

strides=2)

conv2 = tf.layers.conv2d(

inputs=pool1,

filters=64,

kernel_size=[5, 5],

padding="same",

activation=tf.nn.relu)

pool2 = tf.layers.max_pooling2d(inputs=conv2, pool_size=[2, 2],

strides=2)

pool2_flat = tf.reshape(pool2, [-1, 7 * 7 * 64])

dense = tf.layers.dense(inputs=pool2_flat, units=128,

activation=tf.nn.relu)

dropout = tf.layers.dropout(

inputs=dense, rate=0.4,

training=mode == tf.estimator.ModeKeys.TRAIN)

logits = tf.layers.dense(inputs=dropout, units=10)

onehot_labels = tf.one_hot(indices=tf.cast(labels, tf.int32), depth=10)

loss = tf.losses.softmax_cross_entropy(

onehot_labels=onehot_labels, logits=logits)

if mode == tf.estimator.ModeKeys.EVAL:

return tpu_estimator.TPUEstimatorSpec(

mode=mode,

loss=loss,

eval_metrics=(metric_fn, [labels, logits]))

# Train.

decaying_learning_rate = tf.train.exponential_decay(learning_rate,

tf.train.get_global_step(),

100000,0.96)

optimizer = tpu_optimizer.CrossShardOptimizer(

tf.train.GradientDescentOptimizer(

learning_rate=decaying_learning_rate))

train_op = optimizer.minimize(loss,

global_step=tf.train.get_global_step())

return tpu_estimator.TPUEstimatorSpec(mode=mode,

loss=loss, train_op=train_op)

def get_input_fn(filename):

def input_fn(params):

batch_size = params["batch_size"]

def parser(serialized_example):

features = tf.parse_single_example(

serialized_example,

features={

"image_raw": tf.FixedLenFeature([], tf.string),

"label": tf.FixedLenFeature([], tf.int64),

})

image = tf.decode_raw(features["image_raw"], tf.uint8)

image.set_shape([28 * 28])

image = tf.cast(image, tf.float32) * (1\. / 255) - 0.5

label = tf.cast(features["label"], tf.int32)

return image, label

dataset = tf.data.TFRecordDataset(

filename, buffer_size=FLAGS.dataset_reader_buffer_size)

dataset = dataset.map(parser).cache().repeat()

dataset = dataset.apply(

tf.contrib.data.batch_and_drop_remainder(batch_size))

images, labels = dataset.make_one_shot_iterator().get_next()

return images, labels

return input_fn

# TPU config

master = 'local' #URL of the TPU instance

model_dir = '/home/armando/models/mnist'

n_iterations = 50 # number of iterations per TPU training loop

n_shards = 8 # number of TPU chips

run_config = tpu_config.RunConfig(

master=master,

evaluation_master=master,

model_dir=model_dir,

session_config=tf.ConfigProto(

allow_soft_placement=True,

log_device_placement=True

),

tpu_config=tpu_config.TPUConfig(n_iterations,

n_shards

)

)

estimator = tpu_estimator.TPUEstimator(

model_fn=model_fn,

use_tpu=True,

train_batch_size=batch_size,

eval_batch_size=batch_size,

config=run_config)

train_file = '/home/armando/datasets/mnist/train' # input data file

train_steps = 1000 # number of steps to train for

estimator.train(input_fn=get_input_fn(train_file),

max_steps=train_steps

)

eval_file = '/home/armando/datasets/mnist/test' # test data file

eval_steps = 10

estimator.evaluate(input_fn=get_input_fn(eval_file),

steps=eval_steps

)

```

有关在 TPU 上构建模型的更多示例,[请访问此链接](https://github.com/tensorflow/tpu-demos)。

- TensorFlow 1.x 深度学习秘籍

- 零、前言

- 一、TensorFlow 简介

- 二、回归

- 三、神经网络:感知器

- 四、卷积神经网络

- 五、高级卷积神经网络

- 六、循环神经网络

- 七、无监督学习

- 八、自编码器

- 九、强化学习

- 十、移动计算

- 十一、生成模型和 CapsNet

- 十二、分布式 TensorFlow 和云深度学习

- 十三、AutoML 和学习如何学习(元学习)

- 十四、TensorFlow 处理单元

- 使用 TensorFlow 构建机器学习项目中文版

- 一、探索和转换数据

- 二、聚类

- 三、线性回归

- 四、逻辑回归

- 五、简单的前馈神经网络

- 六、卷积神经网络

- 七、循环神经网络和 LSTM

- 八、深度神经网络

- 九、大规模运行模型 -- GPU 和服务

- 十、库安装和其他提示

- TensorFlow 深度学习中文第二版

- 一、人工神经网络

- 二、TensorFlow v1.6 的新功能是什么?

- 三、实现前馈神经网络

- 四、CNN 实战

- 五、使用 TensorFlow 实现自编码器

- 六、RNN 和梯度消失或爆炸问题

- 七、TensorFlow GPU 配置

- 八、TFLearn

- 九、使用协同过滤的电影推荐

- 十、OpenAI Gym

- TensorFlow 深度学习实战指南中文版

- 一、入门

- 二、深度神经网络

- 三、卷积神经网络

- 四、循环神经网络介绍

- 五、总结

- 精通 TensorFlow 1.x

- 一、TensorFlow 101

- 二、TensorFlow 的高级库

- 三、Keras 101

- 四、TensorFlow 中的经典机器学习

- 五、TensorFlow 和 Keras 中的神经网络和 MLP

- 六、TensorFlow 和 Keras 中的 RNN

- 七、TensorFlow 和 Keras 中的用于时间序列数据的 RNN

- 八、TensorFlow 和 Keras 中的用于文本数据的 RNN

- 九、TensorFlow 和 Keras 中的 CNN

- 十、TensorFlow 和 Keras 中的自编码器

- 十一、TF 服务:生产中的 TensorFlow 模型

- 十二、迁移学习和预训练模型

- 十三、深度强化学习

- 十四、生成对抗网络

- 十五、TensorFlow 集群的分布式模型

- 十六、移动和嵌入式平台上的 TensorFlow 模型

- 十七、R 中的 TensorFlow 和 Keras

- 十八、调试 TensorFlow 模型

- 十九、张量处理单元

- TensorFlow 机器学习秘籍中文第二版

- 一、TensorFlow 入门

- 二、TensorFlow 的方式

- 三、线性回归

- 四、支持向量机

- 五、最近邻方法

- 六、神经网络

- 七、自然语言处理

- 八、卷积神经网络

- 九、循环神经网络

- 十、将 TensorFlow 投入生产

- 十一、更多 TensorFlow

- 与 TensorFlow 的初次接触

- 前言

- 1. TensorFlow 基础知识

- 2. TensorFlow 中的线性回归

- 3. TensorFlow 中的聚类

- 4. TensorFlow 中的单层神经网络

- 5. TensorFlow 中的多层神经网络

- 6. 并行

- 后记

- TensorFlow 学习指南

- 一、基础

- 二、线性模型

- 三、学习

- 四、分布式

- TensorFlow Rager 教程

- 一、如何使用 TensorFlow Eager 构建简单的神经网络

- 二、在 Eager 模式中使用指标

- 三、如何保存和恢复训练模型

- 四、文本序列到 TFRecords

- 五、如何将原始图片数据转换为 TFRecords

- 六、如何使用 TensorFlow Eager 从 TFRecords 批量读取数据

- 七、使用 TensorFlow Eager 构建用于情感识别的卷积神经网络(CNN)

- 八、用于 TensorFlow Eager 序列分类的动态循坏神经网络

- 九、用于 TensorFlow Eager 时间序列回归的递归神经网络

- TensorFlow 高效编程

- 图嵌入综述:问题,技术与应用

- 一、引言

- 三、图嵌入的问题设定

- 四、图嵌入技术

- 基于边重构的优化问题

- 应用

- 基于深度学习的推荐系统:综述和新视角

- 引言

- 基于深度学习的推荐:最先进的技术

- 基于卷积神经网络的推荐

- 关于卷积神经网络我们理解了什么

- 第1章概论

- 第2章多层网络

- 2.1.4生成对抗网络

- 2.2.1最近ConvNets演变中的关键架构

- 2.2.2走向ConvNet不变性

- 2.3时空卷积网络

- 第3章了解ConvNets构建块

- 3.2整改

- 3.3规范化

- 3.4汇集

- 第四章现状

- 4.2打开问题

- 参考

- 机器学习超级复习笔记

- Python 迁移学习实用指南

- 零、前言

- 一、机器学习基础

- 二、深度学习基础

- 三、了解深度学习架构

- 四、迁移学习基础

- 五、释放迁移学习的力量

- 六、图像识别与分类

- 七、文本文件分类

- 八、音频事件识别与分类

- 九、DeepDream

- 十、自动图像字幕生成器

- 十一、图像着色

- 面向计算机视觉的深度学习

- 零、前言

- 一、入门

- 二、图像分类

- 三、图像检索

- 四、对象检测

- 五、语义分割

- 六、相似性学习

- 七、图像字幕

- 八、生成模型

- 九、视频分类

- 十、部署

- 深度学习快速参考

- 零、前言

- 一、深度学习的基础

- 二、使用深度学习解决回归问题

- 三、使用 TensorBoard 监控网络训练

- 四、使用深度学习解决二分类问题

- 五、使用 Keras 解决多分类问题

- 六、超参数优化

- 七、从头开始训练 CNN

- 八、将预训练的 CNN 用于迁移学习

- 九、从头开始训练 RNN

- 十、使用词嵌入从头开始训练 LSTM

- 十一、训练 Seq2Seq 模型

- 十二、深度强化学习

- 十三、生成对抗网络

- TensorFlow 2.0 快速入门指南

- 零、前言

- 第 1 部分:TensorFlow 2.00 Alpha 简介

- 一、TensorFlow 2 简介

- 二、Keras:TensorFlow 2 的高级 API

- 三、TensorFlow 2 和 ANN 技术

- 第 2 部分:TensorFlow 2.00 Alpha 中的监督和无监督学习

- 四、TensorFlow 2 和监督机器学习

- 五、TensorFlow 2 和无监督学习

- 第 3 部分:TensorFlow 2.00 Alpha 的神经网络应用

- 六、使用 TensorFlow 2 识别图像

- 七、TensorFlow 2 和神经风格迁移

- 八、TensorFlow 2 和循环神经网络

- 九、TensorFlow 估计器和 TensorFlow HUB

- 十、从 tf1.12 转换为 tf2

- TensorFlow 入门

- 零、前言

- 一、TensorFlow 基本概念

- 二、TensorFlow 数学运算

- 三、机器学习入门

- 四、神经网络简介

- 五、深度学习

- 六、TensorFlow GPU 编程和服务

- TensorFlow 卷积神经网络实用指南

- 零、前言

- 一、TensorFlow 的设置和介绍

- 二、深度学习和卷积神经网络

- 三、TensorFlow 中的图像分类

- 四、目标检测与分割

- 五、VGG,Inception,ResNet 和 MobileNets

- 六、自编码器,变分自编码器和生成对抗网络

- 七、迁移学习

- 八、机器学习最佳实践和故障排除

- 九、大规模训练

- 十、参考文献