# 3.8 多层感知机

我们已经介绍了包括线性回归和softmax回归在内的单层神经网络。然而深度学习主要关注多层模型。在本节中,我们将以多层感知机(multilayer perceptron,MLP)为例,介绍多层神经网络的概念。

## 3.8.1 隐藏层

多层感知机在单层神经网络的基础上引入了一到多个隐藏层(hidden layer)。隐藏层位于输入层和输出层之间。图3.3展示了一个多层感知机的神经网络图,它含有一个隐藏层,该层中有5个隐藏单元。

:-:

<div align=center> 图3.3 带有隐藏层的多层感知机</div>

在图3.3所示的多层感知机中,输入和输出个数分别为4和3,中间的隐藏层中包含了5个隐藏单元(hidden unit)。由于输入层不涉及计算,图3.3中的多层感知机的层数为2。由图3.3可见,隐藏层中的神经元和输入层中各个输入完全连接,输出层中的神经元和隐藏层中的各个神经元也完全连接。因此,多层感知机中的隐藏层和输出层都是全连接层。

具体来说,给定一个小批量样本`$ \boldsymbol{X} \in \mathbb{R}^{n \times d} $`,其批量大小为`$ n $`,输入个数为`$ d $`。假设多层感知机只有一个隐藏层,其中隐藏单元个数为`$ h $`。记隐藏层的输出(也称为隐藏层变量或隐藏变量)为`$ \boldsymbol{H} $`,有`$ \boldsymbol{H} \in \mathbb{R}^{n \times h} $`。因为隐藏层和输出层均是全连接层,可以设隐藏层的权重参数和偏差参数分别为`$ \boldsymbol{W}_h \in \mathbb{R}^{d \times h} $`和 `$ \boldsymbol{b}_h \in \mathbb{R}^{1 \times h} $`,输出层的权重和偏差参数分别为`$ \boldsymbol{W}_o \in \mathbb{R}^{h \times q} $`和`$ \boldsymbol{b}_o \in \mathbb{R}^{1 \times q} $`。

我们先来看一种含单隐藏层的多层感知机的设计。其输出`$ \boldsymbol{O} \in \mathbb{R}^{n \times q} $`的计算为

```[tex]

\begin{aligned}

\boldsymbol{H} &= \boldsymbol{X} \boldsymbol{W}_h + \boldsymbol{b}_h,\\

\boldsymbol{O} &= \boldsymbol{H} \boldsymbol{W}_o + \boldsymbol{b}_o,

\end{aligned}

```

也就是将隐藏层的输出直接作为输出层的输入。如果将以上两个式子联立起来,可以得到

```[tex]

\boldsymbol{O} = (\boldsymbol{X} \boldsymbol{W}_h + \boldsymbol{b}_h)\boldsymbol{W}_o + \boldsymbol{b}_o = \boldsymbol{X} \boldsymbol{W}_h\boldsymbol{W}_o + \boldsymbol{b}_h \boldsymbol{W}_o + \boldsymbol{b}_o.

```

从联立后的式子可以看出,虽然神经网络引入了隐藏层,却依然等价于一个单层神经网络:其中输出层权重参数为`$ \boldsymbol{W}_h\boldsymbol{W}_o $`,偏差参数为`$ \boldsymbol{b}_h \boldsymbol{W}_o + \boldsymbol{b}_o $`。不难发现,即便再添加更多的隐藏层,以上设计依然只能与仅含输出层的单层神经网络等价。

## 3.8.2 激活函数

上述问题的根源在于全连接层只是对数据做仿射变换(affine transformation),而多个仿射变换的叠加仍然是一个仿射变换。解决问题的一个方法是引入非线性变换,例如对隐藏变量使用按元素运算的非线性函数进行变换,然后再作为下一个全连接层的输入。这个非线性函数被称为激活函数(activation function)。下面我们介绍几个常用的激活函数。

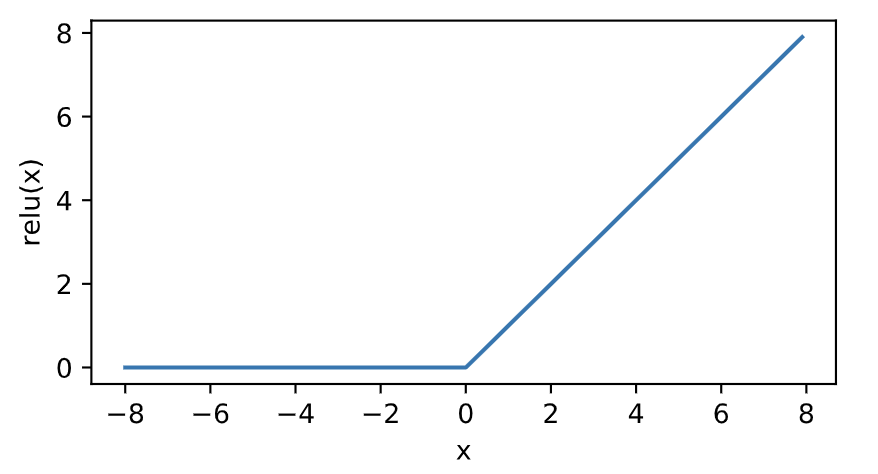

### 3.8.2.1 ReLU函数

ReLU(rectified linear unit)函数提供了一个很简单的非线性变换。给定元素 `$ x $`,该函数定义为

```[tex]

\text{ReLU}(x) = \max(x, 0).

```

可以看出,ReLU函数只保留正数元素,并将负数元素清零。为了直观地观察这一非线性变换,我们先定义一个绘图函数`xyplot`。

``` python

%matplotlib inline

import torch

import numpy as np

import matplotlib.pylab as plt

import sys

sys.path.append("..")

import d2lzh_pytorch as d2l

def xyplot(x_vals, y_vals, name):

d2l.set_figsize(figsize=(5, 2.5))

d2l.plt.plot(x_vals.detach().numpy(), y_vals.detach().numpy())

d2l.plt.xlabel('x')

d2l.plt.ylabel(name + '(x)')

```

我们接下来通过`NDArray`提供的`relu`函数来绘制ReLU函数。可以看到,该激活函数是一个两段线性函数。

``` python

x = torch.arange(-8.0, 8.0, 0.1, requires_grad=True)

y = x.relu()

xyplot(x, y, 'relu')

```

:-:

显然,当输入为负数时,ReLU函数的导数为0;当输入为正数时,ReLU函数的导数为1。尽管输入为0时ReLU函数不可导,但是我们可以取此处的导数为0。下面绘制ReLU函数的导数。

``` python

y.sum().backward()

xyplot(x, x.grad, 'grad of relu')

```

:-:

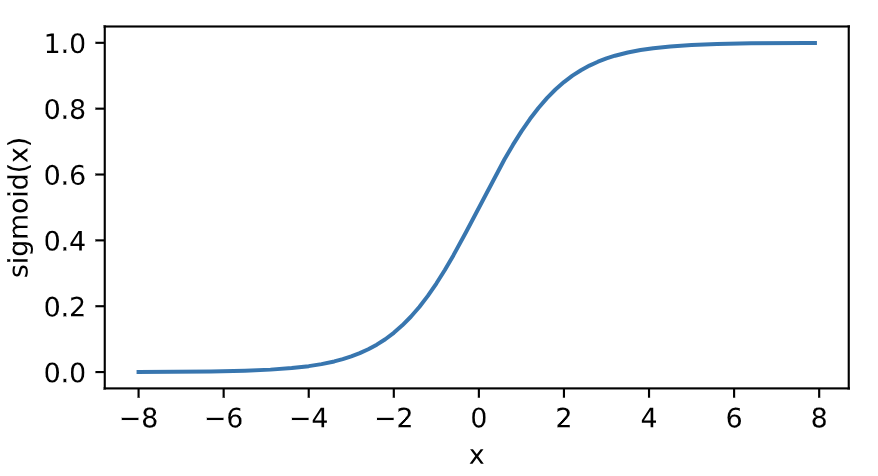

### 3.8.2.2 sigmoid函数

sigmoid函数可以将元素的值变换到0和1之间:

```[tex]

\text{sigmoid}(x) = \frac{1}{1 + \exp(-x)}.

```

sigmoid函数在早期的神经网络中较为普遍,但它目前逐渐被更简单的ReLU函数取代。在后面“循环神经网络”一章中我们会介绍如何利用它值域在0到1之间这一特性来控制信息在神经网络中的流动。下面绘制了sigmoid函数。当输入接近0时,sigmoid函数接近线性变换。

``` python

y = x.sigmoid()

xyplot(x, y, 'sigmoid')

```

:-:

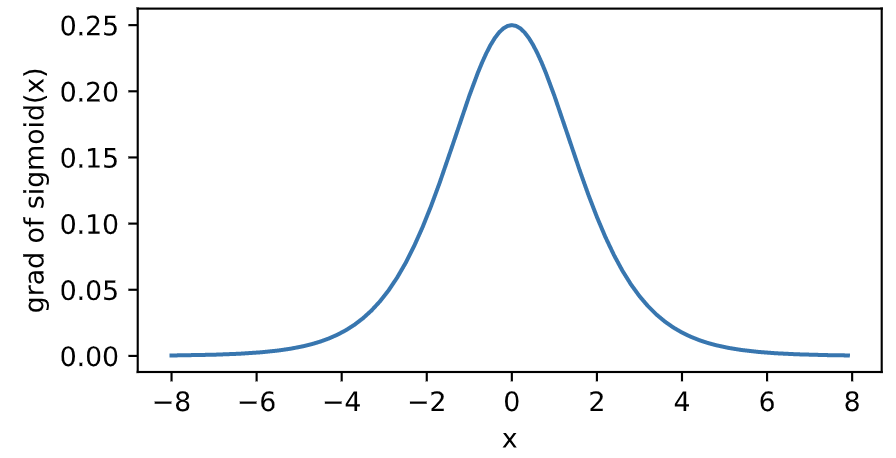

依据链式法则,sigmoid函数的导数

```[tex]

\text{sigmoid}'(x) = \text{sigmoid}(x)\left(1-\text{sigmoid}(x)\right).

```

下面绘制了sigmoid函数的导数。当输入为0时,sigmoid函数的导数达到最大值0.25;当输入越偏离0时,sigmoid函数的导数越接近0。

``` python

x.grad.zero_()

y.sum().backward()

xyplot(x, x.grad, 'grad of sigmoid')

```

:-:

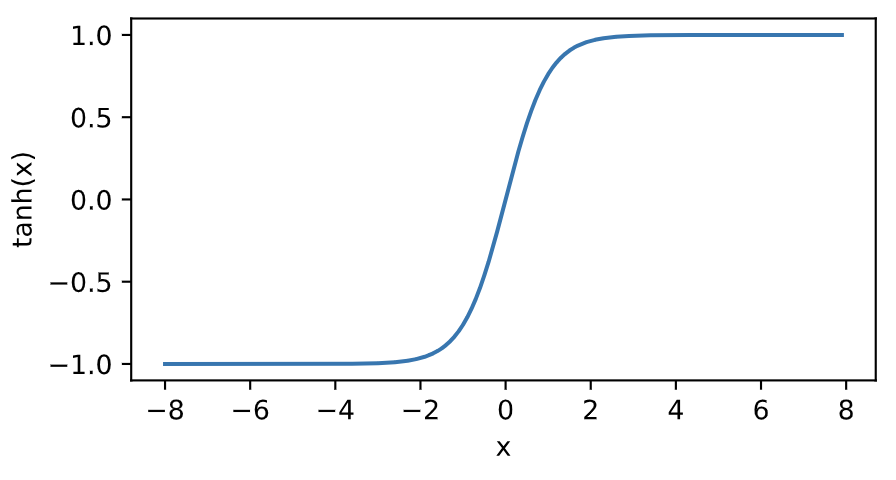

### 3.8.2.3 tanh函数

tanh(双曲正切)函数可以将元素的值变换到-1和1之间:

```[tex]

\text{tanh}(x) = \frac{1 - \exp(-2x)}{1 + \exp(-2x)}.

```

我们接着绘制tanh函数。当输入接近0时,tanh函数接近线性变换。虽然该函数的形状和sigmoid函数的形状很像,但tanh函数在坐标系的原点上对称。

``` python

y = x.tanh()

xyplot(x, y, 'tanh')

```

:-:

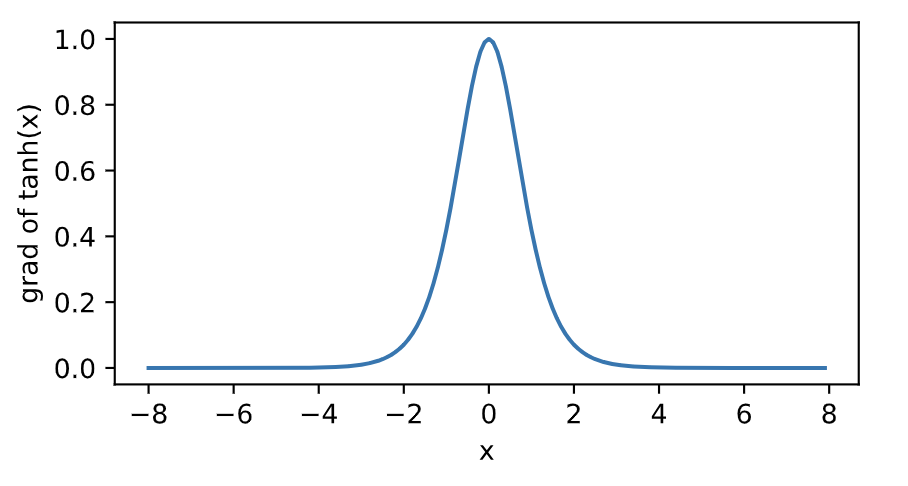

依据链式法则,tanh函数的导数

```[tex]

\text{tanh}'(x) = 1 - \text{tanh}^2(x).

```

下面绘制了tanh函数的导数。当输入为0时,tanh函数的导数达到最大值1;当输入越偏离0时,tanh函数的导数越接近0。

``` python

x.grad.zero_()

y.sum().backward()

xyplot(x, x.grad, 'grad of tanh')

```

## 3.8.3 多层感知机

多层感知机就是含有至少一个隐藏层的由全连接层组成的神经网络,且每个隐藏层的输出通过激活函数进行变换。多层感知机的层数和各隐藏层中隐藏单元个数都是超参数。以单隐藏层为例并沿用本节之前定义的符号,多层感知机按以下方式计算输出:

```[tex]

\begin{aligned}

\boldsymbol{H} &= \phi(\boldsymbol{X} \boldsymbol{W}_h + \boldsymbol{b}_h),\\

\boldsymbol{O} &= \boldsymbol{H} \boldsymbol{W}_o + \boldsymbol{b}_o,

\end{aligned}

```

其中`$ \phi $`表示激活函数。在分类问题中,我们可以对输出`$ \boldsymbol{O} $`做softmax运算,并使用softmax回归中的交叉熵损失函数。

在回归问题中,我们将输出层的输出个数设为1,并将输出`$ \boldsymbol{O} $`直接提供给线性回归中使用的平方损失函数。

## 小结

* 多层感知机在输出层与输入层之间加入了一个或多个全连接隐藏层,并通过激活函数对隐藏层输出进行变换。

* 常用的激活函数包括ReLU函数、sigmoid函数和tanh函数。

-----------

> 注:本节除了代码之外与原书基本相同,[原书传送门](https://zh.d2l.ai/chapter_deep-learning-basics/mlp.html)

- Home

- Introduce

- 1.深度学习简介

- 深度学习简介

- 2.预备知识

- 2.1环境配置

- 2.2数据操作

- 2.3自动求梯度

- 3.深度学习基础

- 3.1 线性回归

- 3.2 线性回归的从零开始实现

- 3.3 线性回归的简洁实现

- 3.4 softmax回归

- 3.5 图像分类数据集(Fashion-MINST)

- 3.6 softmax回归的从零开始实现

- 3.7 softmax回归的简洁实现

- 3.8 多层感知机

- 3.9 多层感知机的从零开始实现

- 3.10 多层感知机的简洁实现

- 3.11 模型选择、反向传播和计算图

- 3.12 权重衰减

- 3.13 丢弃法

- 3.14 正向传播、反向传播和计算图

- 3.15 数值稳定性和模型初始化

- 3.16 实战kaggle比赛:房价预测

- 4 深度学习计算

- 4.1 模型构造

- 4.2 模型参数的访问、初始化和共享

- 4.3 模型参数的延后初始化

- 4.4 自定义层

- 4.5 读取和存储

- 4.6 GPU计算

- 5 卷积神经网络

- 5.1 二维卷积层

- 5.2 填充和步幅

- 5.3 多输入通道和多输出通道

- 5.4 池化层

- 5.5 卷积神经网络(LeNet)

- 5.6 深度卷积神经网络(AlexNet)

- 5.7 使用重复元素的网络(VGG)

- 5.8 网络中的网络(NiN)

- 5.9 含并行连结的网络(GoogLeNet)

- 5.10 批量归一化

- 5.11 残差网络(ResNet)

- 5.12 稠密连接网络(DenseNet)

- 6 循环神经网络

- 6.1 语言模型

- 6.2 循环神经网络

- 6.3 语言模型数据集(周杰伦专辑歌词)

- 6.4 循环神经网络的从零开始实现

- 6.5 循环神经网络的简单实现

- 6.6 通过时间反向传播

- 6.7 门控循环单元(GRU)

- 6.8 长短期记忆(LSTM)

- 6.9 深度循环神经网络

- 6.10 双向循环神经网络

- 7 优化算法

- 7.1 优化与深度学习

- 7.2 梯度下降和随机梯度下降

- 7.3 小批量随机梯度下降

- 7.4 动量法

- 7.5 AdaGrad算法

- 7.6 RMSProp算法

- 7.7 AdaDelta

- 7.8 Adam算法

- 8 计算性能

- 8.1 命令式和符号式混合编程

- 8.2 异步计算

- 8.3 自动并行计算

- 8.4 多GPU计算

- 9 计算机视觉

- 9.1 图像增广

- 9.2 微调

- 9.3 目标检测和边界框

- 9.4 锚框

- 10 自然语言处理

- 10.1 词嵌入(word2vec)

- 10.2 近似训练

- 10.3 word2vec实现

- 10.4 子词嵌入(fastText)

- 10.5 全局向量的词嵌入(Glove)

- 10.6 求近义词和类比词

- 10.7 文本情感分类:使用循环神经网络

- 10.8 文本情感分类:使用卷积网络

- 10.9 编码器--解码器(seq2seq)

- 10.10 束搜索

- 10.11 注意力机制

- 10.12 机器翻译