[TOC]

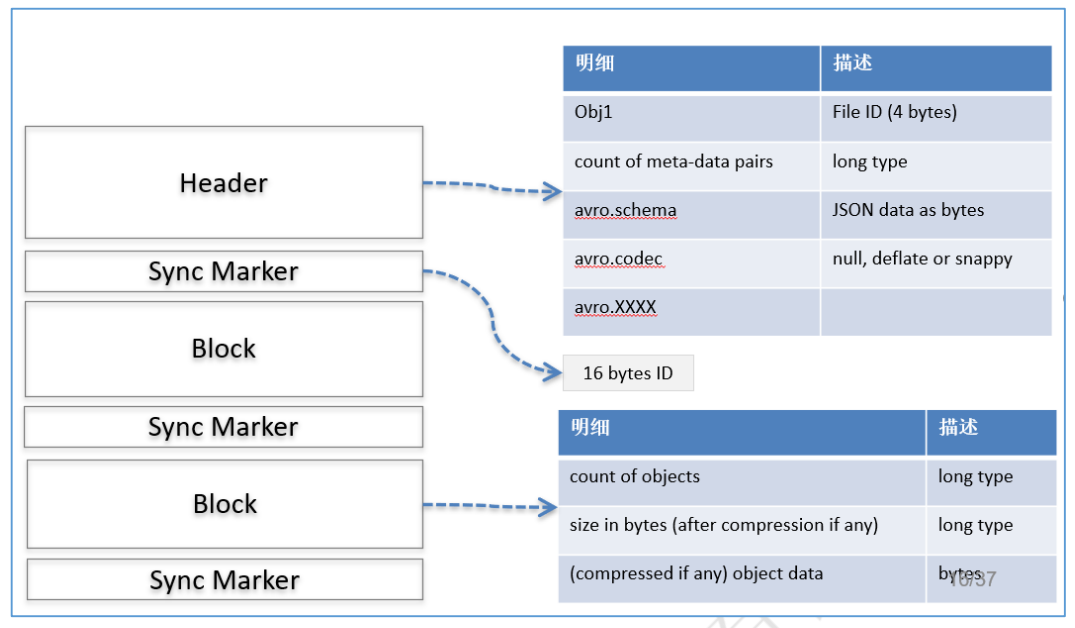

# 1. Avro特点和存储格式

Apache Avro 是一个数据序列化系统,出自 Hadoop 之父 Doug Cutting。

Avro File 以 JSON 格式存储数据定义(Schema),以二进制格式存储数据。

官网地址:http://avro.apache.org/docs/current/ <br/>

特点:

➢ 丰富的数据结构

➢ 快速可压缩的二进制数据格式

➢ 容器文件用于持久化数据

➢ 自带远程过程调用 RPC

➢ 动态语言可以方便地处理 Avro 数据<br/>

:-:

Avro存储格式

<br/>

基本数据类型: null、 boolean、 int、 long、 float、 double、 bytes、 string

复杂数据类型:record、enum、array、map、union、fixed<br/>

可以自己写代码实现 avro 格式,也可以使用 avro-tools 应用(一个jar包)来实现 avro 格式。

<br/>

# 2. 使用avro-tools应用来实现avro格式

(1)在user.avsc文件定义User对象的数据存储格式(Schema)

```json

{

"namespace": "example.avro",

"type": "record",

"name": "User",

"fields": [

{"name": "name", "type": "string"},

{"name": "favorite_number", "type": "int"},

{"name": "favorite_color", "type": "string"}

]}

```

(2)在user.json文件存储数据(data)

```json

{"name": "Alyssa", "favorite_number": 256, "favorite_color": "black"}

{"name": "Ben", "favorite_number": 7, "favorite_color": "red"}

{"name": "Charlie", "favorite_number": 12, "favorite_color": "blue"}

```

(3)

运行 avro-tools.jar将Schema+data生成user.avro文件。

avro-tools.jar可以到https://mvnrepository.com/artifact/org.apache.avro/avro-tools下载。

```sql

[root@hadoop101 /]# java -jar /opt/software/avro-tools-1.8.2.jar fromjson --schema-file \

/hdatas/user.avsc /hdatas/user.json > /hdatas/user.avro

```

或者使用压缩格式:

```sql

[root@hadoop101 /]# java -jar /opt/software/avro-tools-1.8.2.jar fromjson --codec snappy --schema-file \

/hdatas/user.avsc /hdatas/user.json > /hdatas/user.avro

```

(4)我们也可以将user.avro生成回json文件

```sql

-- 查看转换为json数据的格式

[root@hadoop101 /]# java -jar /opt/software/avro-tools-1.8.2.jar tojson /hdatas/user.avro

{"name":"Alyssa","favorite_number":256,"favorite_color":"black"}

{"name":"Ben","favorite_number":7,"favorite_color":"red"}

{"name":"Charlie","favorite_number":12,"favorite_color":"blue"}

-- 将输出存储到user_002.json文件

[root@hadoop101 /]# java -jar /opt/software/avro-tools-1.8.2.jar tojson \

/hdatas/user.avro > /hdatas/user_002.json

```

或者输出为格式化的json文件:

```sql

[root@hadoop101 /]# java -jar /opt/software/avro-tools-1.8.2.jar tojson --pretty /hdatas/user.avro

{

"name" : "Alyssa",

"favorite_number" : 256,

"favorite_color" : "black"

}

{

"name" : "Ben",

"favorite_number" : 7,

"favorite_color" : "red"

}

{

"name" : "Charlie",

"favorite_number" : 12,

"favorite_color" : "blue"

}

[root@hadoop101 /]# java -jar /opt/software/avro-tools-1.8.2.jar tojson --pretty \

/hdatas/user.avro > /hdatas/user_002.json

```

(5)我们也可以获取user.avro的元数据

```sql

-- 查看user.avro的元数据

[root@hadoop101 /]# java -jar /opt/software/avro-tools-1.8.2.jar getmeta /hdatas/user.avro

avro.schema {"type":"record","name":"User","namespace":"example.avro",

"fields":[{"name":"name","type":"string"},

{"name":"favorite_number","type":"int"},

{"name":"favorite_color","type":"string"}]}

avro.codec snappy

```

(6)获取user.avro的schema

```

-- 查看

[root@hadoop101 /]# java -jar /opt/software/avro-tools-1.8.2.jar getschema /hdatas/user.avro

{

"type" : "record",

"name" : "User",

"namespace" : "example.avro",

"fields" : [ {

"name" : "name",

"type" : "string"

}, {

"name" : "favorite_number",

"type" : "int"

}, {

"name" : "favorite_color",

"type" : "string"

} ]

}

-- 将输出存储到user_002.avsc文件中

[root@hadoop101 /]# java -jar /opt/software/avro-tools-1.8.2.jar getschema /hdatas/user.avro > /hdatas/user_002.avsc

```

<br/>

**查看有哪些命令**

```sql

[root@hadoop101 /]# java -jar /opt/software/avro-tools-1.8.2.jar

Version 1.8.2

of Apache Avro

Copyright 2010-2015 The Apache Software Foundation

This product includes software developed at

The Apache Software Foundation (http://www.apache.org/).

----------------

Available tools:

cat extracts samples from files

compile Generates Java code for the given schema.

concat Concatenates avro files without re-compressing.

fragtojson Renders a binary-encoded Avro datum as JSON.

fromjson Reads JSON records and writes an Avro data file.

fromtext Imports a text file into an avro data file.

getmeta Prints out the metadata of an Avro data file.

getschema Prints out schema of an Avro data file.

idl Generates a JSON schema from an Avro IDL file

idl2schemata Extract JSON schemata of the types from an Avro IDL file

induce Induce schema/protocol from Java class/interface via reflection.

jsontofrag Renders a JSON-encoded Avro datum as binary.

random Creates a file with randomly generated instances of a schema.

recodec Alters the codec of a data file.

repair Recovers data from a corrupt Avro Data file

rpcprotocol Output the protocol of a RPC service

rpcreceive Opens an RPC Server and listens for one message.

rpcsend Sends a single RPC message.

tether Run a tethered mapreduce job.

tojson Dumps an Avro data file as JSON, record per line or pretty.

totext Converts an Avro data file to a text file.

totrevni Converts an Avro data file to a Trevni file.

trevni_meta Dumps a Trevni file's metadata as JSON.

trevni_random Create a Trevni file filled with random instances of a schema.

trevni_tojson Dumps a Trevni file as JSON.

```

<br/>

**查看命令有哪些参数**

```sql

[root@hadoop101 /]# java -jar /opt/software/avro-tools-1.8.2.jar fromjson

Expected 1 arg: input_file

Option Description

------ -----------

--codec Compression codec (default: null)

--level <Integer> Compression level (only applies to

deflate and xz) (default: -1)

--schema Schema

--schema-file Schema File

```

<br/>

# 3. Java 读写Avro

在`pom.xml`中添加如下依赖

```xml

<build>

<plugins>

<plugin>

<groupId>org.apache.avro</groupId>

<artifactId>avro-maven-plugin</artifactId>

<version>1.10.1</version>

<executions>

<execution>

<phase>generate-sources</phase>

<goals>

<goal>schema</goal>

</goals>

<configuration>

<sourceDirectory>${project.basedir}/src/main/avro/</sourceDirectory>

<outputDirectory>${project.basedir}/src/main/java/</outputDirectory>

</configuration>

</execution>

</executions>

</plugin>

<plugin>

<groupId>org.apache.maven.plugins</groupId>

<artifactId>maven-compiler-plugin</artifactId>

<configuration>

<source>1.8</source>

<target>1.8</target>

</configuration>

</plugin>

</plugins>

</build>

```

<br/>

## 3.1 使用avro-tools应用生成的代码读写Avro

(1)在user.avsc中定义数据存储格式(Schema)

```sql

{

"namespace": "example.avro",

"type": "record",

"name": "User",

"fields": [

{"name": "name", "type": "string"},

{"name": "favorite_number", "type": "int"},

{"name": "favorite_color", "type": "string"}

]}

```

(2)Avro可以根据Schema生成对应的java类

```sql

[root@hadoop101 /]# java -jar /opt/software/avro-tools-1.8.2.jar \

compile schema /hdatas/user.avsc /hdatas/User.java

```

然后会生成/hdatas/User.java/example/avro/User.java文件。

(3)然后我们调用生成的User对象来创建Avro

```java

package datamodel;

import example.avro.User;

import org.apache.avro.file.DataFileReader;

import org.apache.avro.file.DataFileWriter;

import org.apache.avro.io.DatumReader;

import org.apache.avro.io.DatumWriter;

import org.apache.avro.specific.SpecificDatumReader;

import org.apache.avro.specific.SpecificDatumWriter;

import org.junit.Test;

import java.io.File;

import java.io.IOException;

public class CreateAvro1 {

@Test

public void createAvro() throws IOException {

// 1. 创建User对象,有下面3中构建方法

User user1 = new User();

user1.setName("Alyssa");

user1.setFavoriteNumber(256);

user1.setFavoriteColor("black");

User user2 = new User("Ben", 7, "red");

User user3 = User.newBuilder()

.setName("Charlie")

.setFavoriteNumber(12)

.setFavoriteColor("blue").build();

/*

2. 进行序列化,就是将数据写入user.avro文件中

DatumWriter接口将Java对象转换为内存中的序列化格式;

SpecificDatumWriter类用来生成类并制定生成类的类型;

DataFileWriter用来进行具体的序列化

*/

DatumWriter<User> userDatumWriter = new SpecificDatumWriter<>(User.class);

DataFileWriter<User> dataFileWriter = new DataFileWriter<>(userDatumWriter);

// 生成user.avro文件

dataFileWriter.create(user1.getSchema(), new File("user.avro"));

// 往user.avro中追加数据

dataFileWriter.append(user1);

dataFileWriter.append(user2);

dataFileWriter.append(user3);

// 关闭

dataFileWriter.close();

/*

3. 反序列化,就是将user.avro文件的数据读取出来

*/

File file = new File("user.avro");

DatumReader<User> userDatumReader = new SpecificDatumReader<>(User.class);

DataFileReader<User> dataFileReader = new DataFileReader<User>(file, userDatumReader);

User user = null;

while(dataFileReader.hasNext()) {

user = dataFileReader.next(user);

System.out.println(user);

}

}

}

```

上面的代码输出如下:

```java

{"name": "Alyssa", "favorite_number": 256, "favorite_color": "black"}

{"name": "Ben", "favorite_number": 7, "favorite_color": "red"}

{"name": "Charlie", "favorite_number": 12, "favorite_color": "blue"}

```

<br/>

## 3. 2 自定义代码读写Avro格式

下面我们不借助avro-tools工具来生成我们的Avro。

(1)在user.avsc中定义数据存储格式(Schema)

```sql

{

"namespace": "example.avro",

"type": "record",

"name": "User",

"fields": [

{"name": "name", "type": "string"},

{"name": "favorite_number", "type": "int"},

{"name": "favorite_color", "type": "string"}

]}

```

(2)Java代码

```java

package datamodel;

import org.apache.avro.Schema;

import org.apache.avro.file.DataFileReader;

import org.apache.avro.file.DataFileWriter;

import org.apache.avro.generic.GenericData;

import org.apache.avro.generic.GenericRecord;

import org.apache.avro.io.DatumReader;

import org.apache.avro.io.DatumWriter;

import org.apache.avro.specific.SpecificDatumReader;

import org.apache.avro.specific.SpecificDatumWriter;

import org.junit.Test;

import java.io.File;

import java.io.IOException;

public class CreateAvro2 {

@Test

public void createAvro() throws IOException {

// 1. 获取user.avsc中Schema信息

Schema schema = new Schema.Parser().parse(new File("user.avsc"));

// 2. 创建record

GenericRecord user1 = new GenericData.Record(schema);

user1.put("name", "Alyssa");

user1.put("favorite_number", 256);

user1.put("favorite_color", "black");

GenericRecord user2 = new GenericData.Record(schema);

user2.put("name", "Ben");

user2.put("favorite_number", 7);

user2.put("favorite_color", "red");

GenericRecord user3 = new GenericData.Record(schema);

user3.put("name", "Charlie");

user3.put("favorite_number", 12);

user3.put("favorite_color", "blue");

/*

3. 序列化, 就是将数据写入user.avro文件中

DatumWriter接口将Java对象转换为内存中的序列化格式;

SpecificDatumWriter类用来生成类并制定生成类的类型;

DataFileWriter用来进行具体的序列化

*/

DatumWriter<GenericRecord> userDatumWriter = new SpecificDatumWriter<>(schema);

DataFileWriter<GenericRecord> dataFileWriter = new DataFileWriter<>(userDatumWriter);

// 生成user.avro文件

dataFileWriter.create(user1.getSchema(), new File("user.avro"));

// 往user.avro中追加数据

dataFileWriter.append(user1);

dataFileWriter.append(user2);

dataFileWriter.append(user3);

// 关闭

dataFileWriter.close();

// 4. 反序列化, 就是将user.avro文件的数据读取出来

File file = new File("user.avro");

DatumReader<GenericRecord> userDatumReader = new SpecificDatumReader<>(schema);

DataFileReader<GenericRecord> dataFileReader = new DataFileReader<>(file, userDatumReader);

GenericRecord user = null;

while (dataFileReader.hasNext()) {

user = dataFileReader.next(user);

System.out.println(user);

}

}

}

```

上面的代码输出如下:

```java

{"name": "Alyssa", "favorite_number": 256, "favorite_color": "black"}

{"name": "Ben", "favorite_number": 7, "favorite_color": "red"}

{"name": "Charlie", "favorite_number": 12, "favorite_color": "blue"}

```

<br/>

# 4. 在Hive将Avro作为存储模型

```sql

-- 方式一

create external table user_avro_ext(

name string,

favorite_number int,

favorite_color string

)

stored as avro;

-- 方式二

create table customers

row format serde 'org.apache.hadoop.hive.serde2.avro.AvroSerDe'

stored as inputformat

'org.apache.hadoop.hive.ql.io.avro.AvroContainerInputFormat'

outputformat

'org.apache.hadoop.hive.ql.io.avro.AvroContainerOutputFormat'

tblproperties ('avro.schema.literal'='{

"name": "customer",

"type": "record",

"fields": [

{"name":"firstName", "type":"string"},

{"name":"lastName", "type":"string"},

{"name":"age", "type":"int"},

{"name":"salary", "type":"double"},

{"name":"department", "type":"string"},

{"name":"title", "type":"string"},

{"name": "address", "type": "string"}]}');

```

- Hadoop

- hadoop是什么?

- Hadoop组成

- hadoop官网

- hadoop安装

- hadoop配置

- 本地运行模式配置

- 伪分布运行模式配置

- 完全分布运行模式配置

- HDFS分布式文件系统

- HDFS架构

- HDFS设计思想

- HDFS组成架构

- HDFS文件块大小

- HDFS优缺点

- HDFS Shell操作

- HDFS JavaAPI

- 基本使用

- HDFS的I/O 流操作

- 在SpringBoot项目中的API

- HDFS读写流程

- HDFS写流程

- HDFS读流程

- NN和SNN关系

- NN和SNN工作机制

- Fsimage和 Edits解析

- checkpoint时间设置

- NameNode故障处理

- 集群安全模式

- DataNode工作机制

- 支持的文件格式

- MapReduce分布式计算模型

- MapReduce是什么?

- MapReduce设计思想

- MapReduce优缺点

- MapReduce基本使用

- MapReduce编程规范

- WordCount案例

- MapReduce任务进程

- Hadoop序列化对象

- 为什么要序列化

- 常用数据序列化类型

- 自定义序列化对象

- MapReduce框架原理

- MapReduce工作流程

- MapReduce核心类

- MapTask工作机制

- Shuffle机制

- Partition分区

- Combiner合并

- ReduceTask工作机制

- OutputFormat

- 使用MapReduce实现SQL Join操作

- Reduce join

- Reduce join 代码实现

- Map join

- Map join 案例实操

- MapReduce 开发总结

- Hadoop 优化

- MapReduce 优化需要考虑的点

- MapReduce 优化方法

- 分布式资源调度框架 Yarn

- Yarn 基本架构

- ResourceManager(RM)

- NodeManager(NM)

- ApplicationMaster

- Container

- 作业提交全过程

- JobHistoryServer 使用

- 资源调度器

- 先进先出调度器(FIFO)

- 容量调度器(Capacity Scheduler)

- 公平调度器(Fair Scheduler)

- Yarn 常用命令

- Zookeeper

- zookeeper是什么?

- zookeeper完全分布式搭建

- Zookeeper特点

- Zookeeper数据结构

- Zookeeper 内部原理

- 选举机制

- stat 信息中字段解释

- 选择机制中的概念

- 选举消息内容

- 监听器原理

- Hadoop 高可用集群搭建

- Zookeeper 应用

- Zookeeper Shell操作

- Zookeeper Java应用

- Hive

- Hive是什么?

- Hive的优缺点

- Hive架构

- Hive元数据存储模式

- 内嵌模式

- 本地模式

- 远程模式

- Hive环境搭建

- 伪分布式环境搭建

- Hive命令工具

- 命令行模式

- 交互模式

- Hive数据类型

- Hive数据结构

- 参数配置方式

- Hive数据库

- 数据库存储位置

- 数据库操作

- 表的创建

- 建表基本语法

- 内部表

- 外部表

- 临时表

- 建表高阶语句

- 表的删除与修改

- 分区表

- 静态分区

- 动态分区

- 分桶表

- 创建分桶表

- 分桶抽样

- Hive视图

- 视图的创建

- 侧视图Lateral View

- Hive数据导入导出

- 导入数据

- 导出数据

- 查询表数据量

- Hive事务

- 事务是什么?

- Hive事务的局限性和特点

- Hive事务的开启和设置

- Hive PLSQL

- Hive高阶查询

- 查询基本语法

- 基本查询

- distinct去重

- where语句

- 列正则表达式

- 虚拟列

- CTE查询

- 嵌套查询

- join语句

- 内连接

- 左连接

- 右连接

- 全连接

- 多表连接

- 笛卡尔积

- left semi join

- group by分组

- having刷选

- union与union all

- 排序

- order by

- sort by

- distribute by

- cluster by

- 聚合运算

- 基本聚合

- 高级聚合

- 窗口函数

- 序列窗口函数

- 聚合窗口函数

- 分析窗口函数

- 窗口函数练习

- 窗口子句

- Hive函数

- Hive函数分类

- 字符串函数

- 类型转换函数

- 数学函数

- 日期函数

- 集合函数

- 条件函数

- 聚合函数

- 表生成函数

- 自定义Hive函数

- 自定义函数分类

- 自定义Hive函数流程

- 添加JAR包的方式

- 自定义临时函数

- 自定义永久函数

- Hive优化

- Hive性能调优工具

- EXPLAIN

- ANALYZE

- Fetch抓取

- 本地模式

- 表的优化

- 小表 join 大表

- 大表 join 大表

- 开启Map Join

- group by

- count(distinct)

- 笛卡尔积

- 行列过滤

- 动态分区调整

- 分区分桶表

- 数据倾斜

- 数据倾斜原因

- 调整Map数

- 调整Reduce数

- 产生数据倾斜的场景

- 并行执行

- 严格模式

- JVM重用

- 推测执行

- 启用CBO

- 启动矢量化

- 使用Tez引擎

- 压缩算法和文件格式

- 文件格式

- 压缩算法

- Zeppelin

- Zeppelin是什么?

- Zeppelin安装

- 配置Hive解释器

- Hbase

- Hbase是什么?

- Hbase环境搭建

- Hbase分布式环境搭建

- Hbase伪分布式环境搭建

- Hbase架构

- Hbase架构组件

- Hbase数据存储结构

- Hbase原理

- Hbase Shell

- 基本操作

- 表操作

- namespace

- Hbase Java Api

- Phoenix集成Hbase

- Phoenix是什么?

- 安装Phoenix

- Phoenix数据类型

- Phoenix Shell

- HBase与Hive集成

- HBase与Hive的对比

- HBase与Hive集成使用

- Hbase与Hive集成原理

- HBase优化

- RowKey设计

- 内存优化

- 基础优化

- Hbase管理

- 权限管理

- Region管理

- Region的自动拆分

- Region的预拆分

- 到底采用哪种拆分策略?

- Region的合并

- HFile的合并

- 为什么要有HFile的合并

- HFile合并方式

- Compaction执行时间

- Compaction相关控制参数

- 演示示例

- Sqoop

- Sqoop是什么?

- Sqoop环境搭建

- RDBMS导入到HDFS

- RDBMS导入到Hive

- RDBMS导入到Hbase

- HDFS导出到RDBMS

- 使用sqoop脚本

- Sqoop常用命令

- Hadoop数据模型

- TextFile

- SequenceFile

- Avro

- Parquet

- RC&ORC

- 文件存储格式比较

- Spark

- Spark是什么?

- Spark优势

- Spark与MapReduce比较

- Spark技术栈

- Spark安装

- Spark Shell

- Spark架构

- Spark编程入口

- 编程入口API

- SparkContext

- SparkSession

- Spark的maven依赖

- Spark RDD编程

- Spark核心数据结构-RDD

- RDD 概念

- RDD 特性

- RDD编程

- RDD编程流程

- pom依赖

- 创建算子

- 转换算子

- 动作算子

- 持久化算子

- RDD 与闭包

- csv/json数据源

- Spark分布式计算原理

- RDD依赖

- RDD转换

- RDD依赖

- DAG工作原理

- Spark Shuffle原理

- Shuffle的作用

- ShuffleManager组件

- Shuffle实践

- RDD持久化

- 缓存机制

- 检查点

- 检查点与缓存的区别

- RDD共享变量

- 广播变量

- 累计器

- RDD分区设计

- 数据倾斜

- 数据倾斜的根本原因

- 定位导致的数据倾斜

- 常见数据倾斜解决方案

- Spark SQL

- SQL on Hadoop

- Spark SQL是什么

- Spark SQL特点

- Spark SQL架构

- Spark SQL运行原理

- Spark SQL编程

- Spark SQL编程入口

- 创建Dataset

- Dataset是什么

- SparkSession创建Dataset

- 样例类创建Dataset

- 创建DataFrame

- DataFrame是什么

- 结构化数据文件创建DataFrame

- RDD创建DataFrame

- Hive表创建DataFrame

- JDBC创建DataFrame

- SparkSession创建

- RDD、DataFrame、Dataset

- 三者对比

- 三者相互转换

- RDD转换为DataFrame

- DataFrame转换为RDD

- DataFrame API

- DataFrame API分类

- Action 操作

- 基础 Dataset 函数

- 强类型转换

- 弱类型转换

- Spark SQL外部数据源

- Parquet文件

- Hive表

- RDBMS表

- JSON/CSV

- Spark SQL函数

- Spark SQL内置函数

- 自定SparkSQL函数

- Spark SQL CLI

- Spark SQL性能优化

- Spark GraphX图形数据分析

- 为什么需要图计算

- 图的概念

- 图的术语

- 图的经典表示法

- Spark Graphix简介

- Graphx核心抽象

- Graphx Scala API

- 核心组件

- 属性图应用示例1

- 属性图应用示例2

- 查看图信息

- 图的算子

- 连通分量

- PageRank算法

- Pregel分布式计算框架

- Flume日志收集

- Flume是什么?

- Flume官方文档

- Flume架构

- Flume安装

- Flume使用过程

- Flume组件

- Flume工作流程

- Flume事务

- Source、Channel、Sink文档

- Source文档

- Channel文档

- Sink文档

- Flume拦截器

- Flume拦截器概念

- 配置拦截器

- 自定义拦截器

- Flume可靠性保证

- 故障转移

- 负载均衡

- 多层代理

- 多路复用

- Kafka

- 消息中间件MQ

- Kafka是什么?

- Kafka安装

- Kafka本地单机部署

- Kafka基本命令使用

- Topic的生产与消费

- 基本命令

- 查看kafka目录

- Kafka架构

- Kafka Topic

- Kafka Producer

- Kafka Consumer

- Kafka Partition

- Kafka Message

- Kafka Broker

- 存储策略

- ZooKeeper在Kafka中的作用

- 副本同步

- 容灾

- 高吞吐

- Leader均衡机制

- Kafka Scala API

- Producer API

- Consumer API

- Kafka优化

- 消费者参数优化

- 生产者参数优化

- Spark Streaming

- 什么是流?

- 批处理和流处理

- Spark Streaming简介

- 流数据处理架构

- 内部工作流程

- StreamingContext组件

- SparkStreaming的编程入口

- WordCount案例

- DStream

- DStream是什么?

- Input DStream与Receivers接收器

- DStream API

- 转换操作

- 输出操作

- 数据源

- 数据源分类

- Socket数据源

- 统计HDFS文件的词频

- 处理状态数据

- SparkStreaming整合SparkSQL

- SparkStreaming整合Flume

- SparkStreaming整合Kafka

- 自定义数据源

- Spark Streaming优化策略

- 优化运行时间

- 优化内存使用

- 数据仓库

- 数据仓库是什么?

- 数据仓库的意义

- 数据仓库和数据库的区别

- OLTP和OLAP的区别

- OLTP的特点

- OLAP的特点

- OLTP与OLAP对比

- 数据仓库架构

- Inmon架构

- Kimball架构

- 混合型架构

- 数据仓库的解决方案

- 数据ETL

- 数据仓库建模流程

- 维度模型

- 星型模式

- 雪花模型

- 星座模型

- 数据ETL处理

- 数仓分层术语

- 数据抽取方式

- CDC抽取方案

- 数据转换

- 常见的ETL工具