# 什么是深度学习?

> 原文: [https://machinelearningmastery.com/what-is-deep-learning/](https://machinelearningmastery.com/what-is-deep-learning/)

深度学习是机器学习的一个子领域,涉及受大脑结构和功能激发的算法,称为人工神经网络。

如果你刚刚开始深度学习领域,或者你曾经有过神经网络的经验,你可能会感到困惑。我知道我最初很困惑,许多同事和朋友在 20 世纪 90 年代和 21 世纪初学习和使用神经网络也是如此。

该领域的领导者和专家对深度学习的观点有所了解,这些具体而细微的观点为深度学习的内容提供了很多依据。

在这篇文章中,您将通过听取该领域的一系列专家和领导者的确切了解深度学习的内容。

让我们潜入。

什么是深度学习?

[Kiran Foster](https://www.flickr.com/photos/rueful/7885846128/) 的照片,保留一些权利。

## 深度学习是大型神经网络

[来自百度研究院 Coursera 和首席科学家的 Andrew Ng](https://en.wikipedia.org/wiki/Andrew_Ng) 正式成立了 [Google Brain](https://en.wikipedia.org/wiki/Google_Brain) ,最终导致了大量 Google 服务中深度学习技术的产品化。

他已经说了很多关于深度学习的内容并写了很多,并且是一个很好的起点。

在深度学习的早期讨论中,安德鲁描述了传统人工神经网络背景下的深度学习。在 2013 年题为“[深度学习,自学习和无监督特征学习](https://www.youtube.com/watch?v=n1ViNeWhC24)”的演讲中,他将深度学习的理念描述为:

> 使用大脑模拟,希望:

>

> - 使学习算法更好,更容易使用。

>

> - 在机器学习和人工智能方面取得革命性进展。

>

> 我相信这是我们迈向真正人工智能的最好机会

后来他的评论变得更加细致入微了。

根据安德鲁的深度学习的核心是我们现在拥有足够快的计算机和足够的数据来实际训练大型神经网络。在讨论为什么现在是 2015 年 ExtractConf 在深度学习的时候,题为“[科学家应该了解的关于深度学习](https://www.youtube.com/watch?v=O0VN0pGgBZM)的数据”,他评论说:

> 我们现在拥有的非常大的神经网络......以及我们可以访问的大量数据

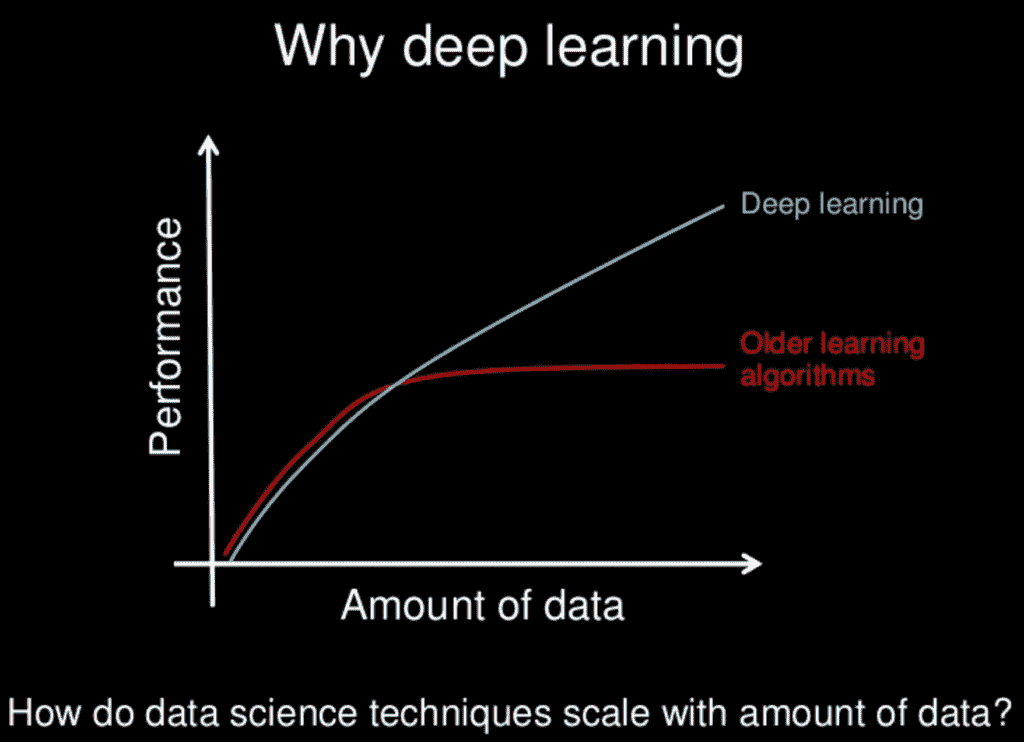

他还评论了关于规模的重要观点。当我们构建更大的神经网络并用越来越多的数据训练它们时,它们的表现会不断提高。这通常与其他在表现上达到稳定水平的机器学习技术不同。

> 对于旧代学习算法的大多数风格......表现将达到稳定水平。 ......深度学习......是第一类算法......可扩展。 ...随着您提供更多数据,表现会不断提高

他在幻灯片中提供了一个漂亮的卡通片:

为何深度学习?

滑动 [Andrew Ng](http://www.slideshare.net/ExtractConf) ,保留所有权利。

最后,他清楚地指出,我们在实践中看到的深度学习的好处来自有监督的学习。从 2015 年的 ExtractConf 演讲中,他评论道:

> 今天深度学习的几乎所有价值都是通过有监督的学习或从标记数据中学习

早些时候,斯坦福大学在 2014 年的一次题为“[深度学习](https://www.youtube.com/watch?v=W15K9PegQt0)”的演讲中,他做了类似的评论:

> 深度学习像疯了一样起飞的一个原因是因为它在监督学习中很棒

安德鲁经常提到我们应该并且会看到更多的好处来自轨道的无人监督的一面,因为该领域已经成熟,可以处理大量未标记的数据。

[Jeff Dean](https://en.wikipedia.org/wiki/Jeff_Dean_(computer_scientist)) 是 Google 的系统和基础设施小组的向导和谷歌高级研究员,并参与并可能部分负责 Google 内部深度学习的扩展和采用。 Jeff 参与了 Google Brain 项目以及大型深度学习软件 DistBelief 和后来的 TensorFlow 的开发。

在 2016 年题为“[建立智能计算机系统深度学习](https://www.youtube.com/watch?v=QSaZGT4-6EY)”的演讲中,他以类似的方式发表评论,深度学习实际上是关于大型神经网络的。

> 当你听到深度学习这个词的时候,就想想一个大的深度神经网络。深度指的是典型的层数,因此这种流行术语在印刷机中被采用。我认为它们通常是深度神经网络。

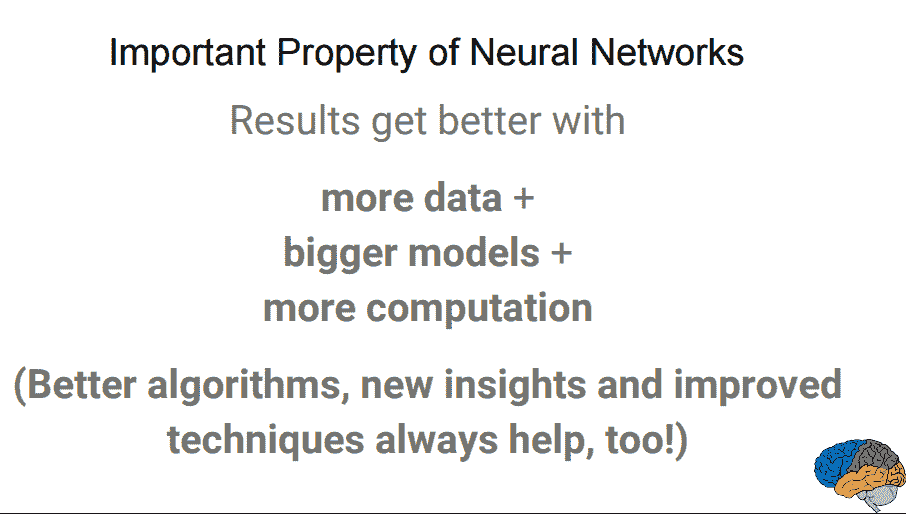

他已经多次发表过这个演讲,并且在[改进的幻灯片中为同一个演讲](http://static.googleusercontent.com/media/research.google.com/en//people/jeff/BayLearn2015.pdf),他强调了神经网络的可扩展性,表明随着更多的数据和更大的模型,结果会变得更好更多计算训练。

结果更好,更多数据,更大型号,更多计算

滑动 [Jeff Dean](http://static.googleusercontent.com/media/research.google.com/en//people/jeff/BayLearn2015.pdf) ,保留所有权利。

## 深度学习是分层特征学习

除了可扩展性之外,深度学习模型的另一个经常被引用的好处是它们能够从原始数据执行自动特征提取,也称为[特征学习](https://en.wikipedia.org/wiki/Feature_learning)。

[Yoshua Bengio](https://en.wikipedia.org/wiki/Yoshua_Bengio) 是深度学习的另一个领导者,尽管他开始对大型神经网络能够实现的自动特征学习产生浓厚的兴趣。

他描述了使用特征学习发现和学习良好表示的算法能力方面的深度学习。在 2012 年题为“[深度学习无监督和转移学习的表达](http://www.jmlr.org/proceedings/papers/v27/bengio12a/bengio12a.pdf)”的论文中,他评论道:

> 深度学习算法试图利用输入分布中的未知结构,以便通常在多个级别上发现良好的表示,并使用较低级别的特征定义更高级别的学习特征

他在 2009 年的技术报告“[为 AI](http://www.iro.umontreal.ca/~lisa/publications2/index.php/publications/show/239) 学习深层架构”中提供了深入学习的详细视角,其中强调了特征学习中层次结构的重要性。

> 深度学习方法旨在学习具有来自较低级别特征的组成所形成的较高级别的层级的特征的特征层级。在多个抽象级别自动学习功能允许系统学习直接从数据将输入映射到输出的复杂功能,而不完全依赖于人工制作的功能。

在即将出版的名为“[深度学习](http://www.deeplearningbook.org)”的书中,他与 Ian Goodfellow 和 Aaron Courville 合着,他们根据模型的架构深度来定义深度学习。

> 概念的层次结构允许计算机通过用简单的概念构建它们来学习复杂的概念。如果我们绘制一个图表来显示这些概念是如何相互构建的,那么图表很深,有很多层。出于这个原因,我们将这种方法称为 AI 深度学习。

这是一本重要的书,有可能在一段时间内成为该领域的权威资源。本书继续描述多层感知器作为深度学习领域中使用的算法,给出了深度学习已包含在人工神经网络中的观点。

> 深度学习模型的典型例子是前馈深度网络或多层感知器(MLP)。

[Peter Norvig](https://en.wikipedia.org/wiki/Peter_Norvig) 是谷歌研究部主任,以其题为“[人工智能:现代方法](http://www.amazon.com/dp/0136042597?tag=inspiredalgor-20)”的人工智能教科书而闻名。

在 2016 年的一次演讲中,他给出了题为“[深度学习和可理解性与软件工程和验证](https://www.youtube.com/watch?v=X769cyzBNVw)”的内容,他以与 Yoshua 非常相似的方式定义了深度学习,重点关注使用更深层网络结构所允许的抽象功能。

> 一种学习,你形成的表示有几个抽象层次,而不是输出的直接输入

## 为什么称它为“深度学习”?

为什么不只是“人工神经网络”?

[Geoffrey Hinton](https://en.wikipedia.org/wiki/Geoffrey_Hinton) 是人工神经网络领域的先驱,并共同发表了关于[反向传播](https://en.wikipedia.org/wiki/Backpropagation)算法的第一篇论文,用于训练多层感知器网络。

他可能已经开始引入措辞“ _deep_ ”来描述大型人工神经网络的发展。

他在 2006 年共同撰写了一篇题为“[深度信念网快速学习算法](http://www.mitpressjournals.org/doi/pdf/10.1162/neco.2006.18.7.1527)”的论文,其中描述了一种训练“深度”(如在多层网络中)受限制的 Boltzmann 机器的方法。

> 使用互补先验,我们推导出一种快速,贪婪的算法,可以一次一层地学习深层定向信念网络,前提是前两层形成一个无向联想记忆。

本文和 Geoff 在一个无向深度网络上共同撰写的题为“ [Deep Boltzmann Machines](http://www.jmlr.org/proceedings/papers/v5/salakhutdinov09a/salakhutdinov09a.pdf) ”的相关论文得到了社区的好评(现已引用数百次),因为它们是贪婪层的成功例子 - 明智的网络训练,在前馈网络中允许更多层。

在科学的一篇题为“[用神经网络降低数据维度](https://www.cs.toronto.edu/~hinton/science.pdf)”的共同撰写的文章中,他们坚持使用相同的“深度”描述来描述他们开发网络的方法,这些网络的层数比以前更多。

> 我们描述了一种初始化权重的有效方法,它允许深度自动编码器网络学习低维度代码,这些代码比主成分分析更好地作为减少数据维度的工具。

在同一篇文章中,他们发表了一篇有趣的评论,与 Andrew Ng 关于最近计算能力的提高以及对大型数据集的访问的评论相互关联,这些数据集在大规模使用时释放了神经网络尚未开发的能力。

> 自 20 世纪 80 年代以来,显而易见的是,通过深度自动编码器的反向传播对于非线性降维是非常有效的,只要计算机足够快,数据集足够大,并且初始权重足够接近良好的解决方案。现在满足所有这三个条件。

在 2016 年皇家学会题为“[深度学习](https://www.youtube.com/watch?v=VhmE_UXDOGs)”的演讲中,Geoff 评论说深度信念网络是 2006 年深度学习的开始,并且这一新的深度学习浪潮的首次成功应用是 2009 年的语音识别标题为“[声学建模使用深度信念网络](http://www.cs.toronto.edu/~asamir/papers/speechDBN_jrnl.pdf)”,实现了最先进的结果。

结果使语音识别和神经网络社区注意到,使用“深度”作为先前神经网络技术的差异因素,可能导致名称改变。

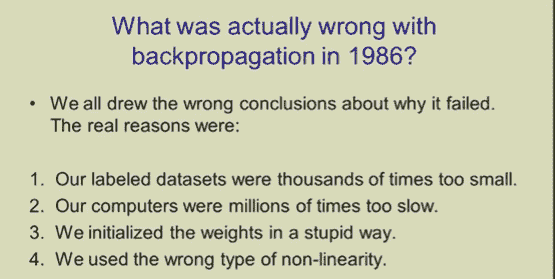

皇家学会谈话中对深度学习的描述非常反向传播,正如您所期望的那样。有趣的是,他提出了为什么反向传播(读“深度学习”)在上世纪 90 年代没有起飞的 4 个原因。前两点与安德鲁·吴(Andrew Ng)的评论相符,关于数据集太小而计算机太慢。

1986 年背向传播实际上是错误的?

滑动 [Geoff Hinton](https://www.youtube.com/watch?v=VhmE_UXDOGs) ,保留所有权利。

## 深度学习作为跨域的可扩展学习

深度学习在输入(甚至输出)是模拟的问题域上表现优异。意思是,它们不是表格格式的少量数量,而是像素数据,文本数据文档或音频数据文件的图像。

[Yann LeCun](https://en.wikipedia.org/wiki/Yann_LeCun) 是 Facebook Research 的主管,是网络架构之父,擅长图像数据中的对象识别,称为[卷积神经网络(CNN)](http://machinelearningmastery.com/crash-course-convolutional-neural-networks/)。这种技术看起来非常成功,因为像多层感知器前馈神经网络一样,该技术可以根据数据和模型大小进行扩展,并且可以通过反向传播进行训练。

这使他对深度学习的定义偏向于非常大的 CNN 的发展,这些 CNN 在照片中的对象识别方面取得了巨大成功。

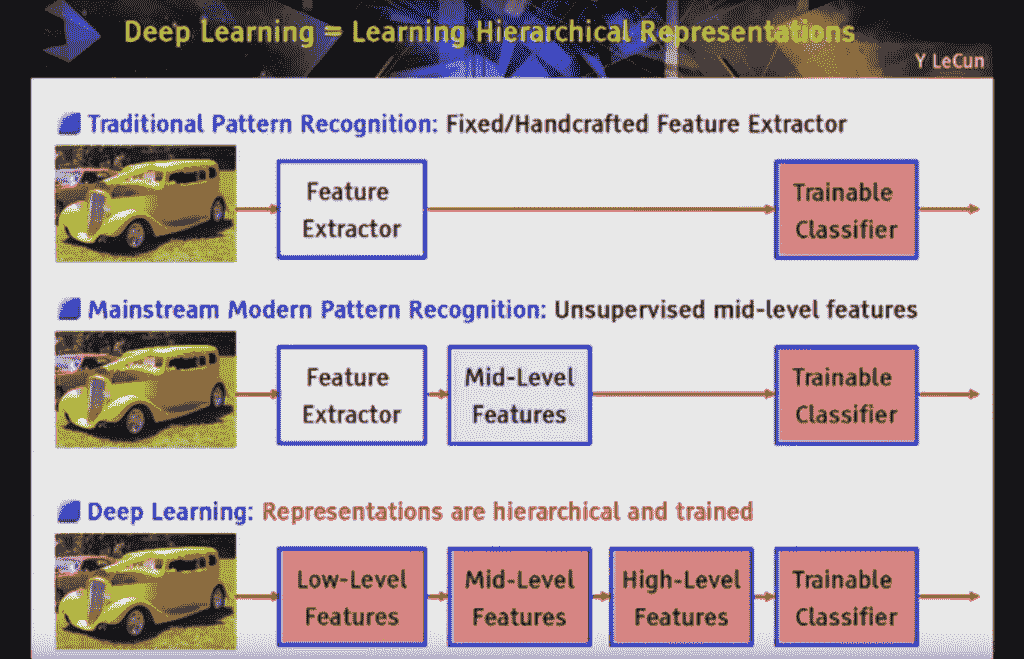

在劳伦斯利弗莫尔国家实验室 2016 年的一次题为“[加速理解:深度学习,智能应用和 GPU](https://www.youtube.com/watch?v=Qk4SqF9FT-M) ”的演讲中,他将深度学习描述为学习层次表示,并将其定义为构建对象识别系统的可扩展方法:

> 深度学习[是] ...所有可训练的模块管道。 ......因为在识别一个物体的过程中有多个阶段,所有这些阶段都是训练的一部分“

深度学习=学习等级表示

滑动 [Yann LeCun](https://www.youtube.com/watch?v=Qk4SqF9FT-M) ,保留所有权利。

[Jurgen Schmidhuber](https://en.wikipedia.org/wiki/J%C3%BCrgen_Schmidhuber) 是另一种流行算法的父亲,它像 MLP 和 CNN 一样也可以根据模型大小和数据集大小进行扩展,并且可以通过反向传播进行训练,而是针对学习序列数据进行定制,称为 [Long 短期记忆网络(LSTM)](http://machinelearningmastery.com/crash-course-recurrent-neural-networks-deep-learning/),一种递归神经网络。

我们确实看到在该领域的措辞中存在一些混淆,即“深度学习”。在 2014 年题为“[神经网络中的深度学习:概述](http://arxiv.org/pdf/1404.7828v4.pdf)”的论文中,他对该领域的问题命名以及深度与浅层学习的区分进行了评论。他还有趣地描述了问题复杂性的深度,而不是用于解决问题的模型。

> Shallow Learning 在哪个问题深度结束,深度学习开始了?与 DL 专家的讨论尚未对这一问题作出结论性回应。 [...],让我只为此概述的目的定义:深度问题> 10 需要非常深度学习。

[Demis Hassabis](https://en.wikipedia.org/wiki/Demis_Hassabis) 是 [DeepMind](https://deepmind.com/) 的创始人,后来被谷歌收购。 DeepMind 突破了将深度学习技术与强化学习相结合,以处理复杂的学习问题,如玩游戏,在玩 Atari 游戏和游戏 Go with Alpha Go 时出类拔萃。

为了与命名保持一致,他们将他们的新技术称为深度 Q 网络,将深度学习与 Q-Learning 结合起来。他们还将更广泛的研究领域命名为“深层强化学习”。

在他们的 2015 年自然论文题为“[通过深度强化学习](http://www.nature.com/nature/journal/v518/n7540/full/nature14236.html)进行人类控制”中,他们评论了深度神经网络在突破中的重要作用,并强调了对分层抽象的需求。

> 为了实现这一目标,我们开发了一种新型代理,一种深度 Q 网络(DQN),它能够将强化学习与一类称为深度神经网络的人工神经网络相结合。值得注意的是,深度神经网络的最新进展使得人工神经网络可以直接从原始传感数据中学习诸如对象类别之类的概念,其中使用若干层节点来逐渐建立数据的抽象表示。

最后,在可能被认为是该领域的定义论文中,Yann LeCun,Yoshua Bengio 和 Geoffrey Hinton 在自然界发表了一篇题为“[深度学习](http://www.nature.com/nature/journal/v521/n7553/full/nature14539.html)”的论文。在其中,他们打开了一个清晰的深度学习定义,突出了多层次的方法。

> 深度学习允许由多个处理层组成的计算模型来学习具有多个抽象级别的数据表示。

后来,在表示学习和抽象方面描述了多层方法。

> 深度学习方法是具有多个表示级别的表示学习方法,通过组合简单但非线性的模块获得,每个模块将表示在一个级别(从原始输入开始)转换为更高,稍微更抽象级别的表示。 [...]深度学习的关键方面是这些功能层不是由人类工程师设计的:它们是使用通用学习程序从数据中学习的。

这是一个很好的通用描述,可以很容易地描述大多数人工神经网络算法。这也是一个很好的结束。

## 摘要

在这篇文章中,您发现深度学习只是对更多数据的非常大的神经网络,需要更大的计算机。

虽然 Hinton 和合作者发表的早期方法侧重于贪婪的分层训练和无监督方法,如自动编码器,但现代最先进的深度学习主要集中在使用反向传播算法训练深层(多层)神经网络模型。最流行的技术是:

* 多层感知器网络。

* 卷积神经网络。

* 长短期记忆回归神经网络。

我希望这已经清除了深层学习的内容以及领导定义如何在一个保护伞下融合在一起。

如果您对深度学习或此帖有任何疑问,请在下面的评论中提出您的问题,我会尽力回答。

- Machine Learning Mastery 应用机器学习教程

- 5竞争机器学习的好处

- 过度拟合的简单直觉,或者为什么测试训练数据是一个坏主意

- 特征选择简介

- 应用机器学习作为一个搜索问题的温和介绍

- 为什么应用机器学习很难

- 为什么我的结果不如我想的那么好?你可能过度拟合了

- 用ROC曲线评估和比较分类器表现

- BigML评论:发现本机学习即服务平台的聪明功能

- BigML教程:开发您的第一个决策树并进行预测

- 构建生产机器学习基础设施

- 分类准确性不够:可以使用更多表现测量

- 一种预测模型的巧妙应用

- 机器学习项目中常见的陷阱

- 数据清理:将凌乱的数据转换为整洁的数据

- 机器学习中的数据泄漏

- 数据,学习和建模

- 数据管理至关重要以及为什么需要认真对待它

- 将预测模型部署到生产中

- 参数和超参数之间有什么区别?

- 测试和验证数据集之间有什么区别?

- 发现特征工程,如何设计特征以及如何获得它

- 如何开始使用Kaggle

- 超越预测

- 如何在评估机器学习算法时选择正确的测试选项

- 如何定义机器学习问题

- 如何评估机器学习算法

- 如何获得基线结果及其重要性

- 如何充分利用机器学习数据

- 如何识别数据中的异常值

- 如何提高机器学习效果

- 如何在竞争机器学习中踢屁股

- 如何知道您的机器学习模型是否具有良好的表现

- 如何布局和管理您的机器学习项目

- 如何为机器学习准备数据

- 如何减少最终机器学习模型中的方差

- 如何使用机器学习结果

- 如何解决像数据科学家这样的问题

- 通过数据预处理提高模型精度

- 处理机器学习的大数据文件的7种方法

- 建立机器学习系统的经验教训

- 如何使用机器学习清单可靠地获得准确的预测(即使您是初学者)

- 机器学习模型运行期间要做什么

- 机器学习表现改进备忘单

- 来自世界级从业者的机器学习技巧:Phil Brierley

- 模型预测精度与机器学习中的解释

- 竞争机器学习的模型选择技巧

- 机器学习需要多少训练数据?

- 如何系统地规划和运行机器学习实验

- 应用机器学习过程

- 默认情况下可重现的机器学习结果

- 10个实践应用机器学习的标准数据集

- 简单的三步法到最佳机器学习算法

- 打击机器学习数据集中不平衡类的8种策略

- 模型表现不匹配问题(以及如何处理)

- 黑箱机器学习的诱惑陷阱

- 如何培养最终的机器学习模型

- 使用探索性数据分析了解您的问题并获得更好的结果

- 什么是数据挖掘和KDD

- 为什么One-Hot在机器学习中编码数据?

- 为什么你应该在你的机器学习问题上进行抽样检查算法

- 所以,你正在研究机器学习问题......

- Machine Learning Mastery Keras 深度学习教程

- Keras 中神经网络模型的 5 步生命周期

- 在 Python 迷你课程中应用深度学习

- Keras 深度学习库的二元分类教程

- 如何用 Keras 构建多层感知器神经网络模型

- 如何在 Keras 中检查深度学习模型

- 10 个用于 Amazon Web Services 深度学习的命令行秘籍

- 机器学习卷积神经网络的速成课程

- 如何在 Python 中使用 Keras 进行深度学习的度量

- 深度学习书籍

- 深度学习课程

- 你所知道的深度学习是一种谎言

- 如何设置 Amazon AWS EC2 GPU 以训练 Keras 深度学习模型(分步)

- 神经网络中批量和迭代之间的区别是什么?

- 在 Keras 展示深度学习模型训练历史

- 基于 Keras 的深度学习模型中的dropout正则化

- 评估 Keras 中深度学习模型的表现

- 如何评价深度学习模型的技巧

- 小批量梯度下降的简要介绍以及如何配置批量大小

- 在 Keras 中获得深度学习帮助的 9 种方法

- 如何使用 Keras 在 Python 中网格搜索深度学习模型的超参数

- 用 Keras 在 Python 中使用卷积神经网络进行手写数字识别

- 如何用 Keras 进行预测

- 用 Keras 进行深度学习的图像增强

- 8 个深度学习的鼓舞人心的应用

- Python 深度学习库 Keras 简介

- Python 深度学习库 TensorFlow 简介

- Python 深度学习库 Theano 简介

- 如何使用 Keras 函数式 API 进行深度学习

- Keras 深度学习库的多类分类教程

- 多层感知器神经网络速成课程

- 基于卷积神经网络的 Keras 深度学习库中的目标识别

- 流行的深度学习库

- 用深度学习预测电影评论的情感

- Python 中的 Keras 深度学习库的回归教程

- 如何使用 Keras 获得可重现的结果

- 如何在 Linux 服务器上运行深度学习实验

- 保存并加载您的 Keras 深度学习模型

- 用 Keras 逐步开发 Python 中的第一个神经网络

- 用 Keras 理解 Python 中的有状态 LSTM 循环神经网络

- 在 Python 中使用 Keras 深度学习模型和 Scikit-Learn

- 如何使用预训练的 VGG 模型对照片中的物体进行分类

- 在 Python 和 Keras 中对深度学习模型使用学习率调度

- 如何在 Keras 中可视化深度学习神经网络模型

- 什么是深度学习?

- 何时使用 MLP,CNN 和 RNN 神经网络

- 为什么用随机权重初始化神经网络?

- Machine Learning Mastery 深度学习 NLP 教程

- 深度学习在自然语言处理中的 7 个应用

- 如何实现自然语言处理的波束搜索解码器

- 深度学习文档分类的最佳实践

- 关于自然语言处理的热门书籍

- 在 Python 中计算文本 BLEU 分数的温和介绍

- 使用编码器 - 解码器模型的用于字幕生成的注入和合并架构

- 如何用 Python 清理机器学习的文本

- 如何配置神经机器翻译的编码器 - 解码器模型

- 如何开始深度学习自然语言处理(7 天迷你课程)

- 自然语言处理的数据集

- 如何开发一种深度学习的词袋模型来预测电影评论情感

- 深度学习字幕生成模型的温和介绍

- 如何在 Keras 中定义神经机器翻译的编码器 - 解码器序列 - 序列模型

- 如何利用小实验在 Keras 中开发字幕生成模型

- 如何从头开发深度学习图片标题生成器

- 如何在 Keras 中开发基于字符的神经语言模型

- 如何开发用于情感分析的 N-gram 多通道卷积神经网络

- 如何从零开始开发神经机器翻译系统

- 如何在 Python 中用 Keras 开发基于单词的神经语言模型

- 如何开发一种预测电影评论情感的词嵌入模型

- 如何使用 Gensim 在 Python 中开发词嵌入

- 用于文本摘要的编码器 - 解码器深度学习模型

- Keras 中文本摘要的编码器 - 解码器模型

- 用于神经机器翻译的编码器 - 解码器循环神经网络模型

- 浅谈词袋模型

- 文本摘要的温和介绍

- 编码器 - 解码器循环神经网络中的注意力如何工作

- 如何利用深度学习自动生成照片的文本描述

- 如何开发一个单词级神经语言模型并用它来生成文本

- 浅谈神经机器翻译

- 什么是自然语言处理?

- 牛津自然语言处理深度学习课程

- 如何为机器翻译准备法语到英语的数据集

- 如何为情感分析准备电影评论数据

- 如何为文本摘要准备新闻文章

- 如何准备照片标题数据集以训练深度学习模型

- 如何使用 Keras 为深度学习准备文本数据

- 如何使用 scikit-learn 为机器学习准备文本数据

- 自然语言处理神经网络模型入门

- 对自然语言处理的深度学习的承诺

- 在 Python 中用 Keras 进行 LSTM 循环神经网络的序列分类

- 斯坦福自然语言处理深度学习课程评价

- 统计语言建模和神经语言模型的简要介绍

- 使用 Keras 在 Python 中进行 LSTM 循环神经网络的文本生成

- 浅谈机器学习中的转换

- 如何使用 Keras 将词嵌入层用于深度学习

- 什么是用于文本的词嵌入

- Machine Learning Mastery 深度学习时间序列教程

- 如何开发人类活动识别的一维卷积神经网络模型

- 人类活动识别的深度学习模型

- 如何评估人类活动识别的机器学习算法

- 时间序列预测的多层感知器网络探索性配置

- 比较经典和机器学习方法进行时间序列预测的结果

- 如何通过深度学习快速获得时间序列预测的结果

- 如何利用 Python 处理序列预测问题中的缺失时间步长

- 如何建立预测大气污染日的概率预测模型

- 如何开发一种熟练的机器学习时间序列预测模型

- 如何构建家庭用电自回归预测模型

- 如何开发多步空气污染时间序列预测的自回归预测模型

- 如何制定多站点多元空气污染时间序列预测的基线预测

- 如何开发时间序列预测的卷积神经网络模型

- 如何开发卷积神经网络用于多步时间序列预测

- 如何开发单变量时间序列预测的深度学习模型

- 如何开发 LSTM 模型用于家庭用电的多步时间序列预测

- 如何开发 LSTM 模型进行时间序列预测

- 如何开发多元多步空气污染时间序列预测的机器学习模型

- 如何开发多层感知器模型进行时间序列预测

- 如何开发人类活动识别时间序列分类的 RNN 模型

- 如何开始深度学习的时间序列预测(7 天迷你课程)

- 如何网格搜索深度学习模型进行时间序列预测

- 如何对单变量时间序列预测的网格搜索朴素方法

- 如何在 Python 中搜索 SARIMA 模型超参数用于时间序列预测

- 如何在 Python 中进行时间序列预测的网格搜索三次指数平滑

- 一个标准的人类活动识别问题的温和介绍

- 如何加载和探索家庭用电数据

- 如何加载,可视化和探索复杂的多变量多步时间序列预测数据集

- 如何从智能手机数据模拟人类活动

- 如何根据环境因素预测房间占用率

- 如何使用脑波预测人眼是开放还是闭合

- 如何在 Python 中扩展长短期内存网络的数据

- 如何使用 TimeseriesGenerator 进行 Keras 中的时间序列预测

- 基于机器学习算法的室内运动时间序列分类

- 用于时间序列预测的状态 LSTM 在线学习的不稳定性

- 用于罕见事件时间序列预测的 LSTM 模型体系结构

- 用于时间序列预测的 4 种通用机器学习数据变换

- Python 中长短期记忆网络的多步时间序列预测

- 家庭用电机器学习的多步时间序列预测

- Keras 中 LSTM 的多变量时间序列预测

- 如何开发和评估朴素的家庭用电量预测方法

- 如何为长短期记忆网络准备单变量时间序列数据

- 循环神经网络在时间序列预测中的应用

- 如何在 Python 中使用差异变换删除趋势和季节性

- 如何在 LSTM 中种子状态用于 Python 中的时间序列预测

- 使用 Python 进行时间序列预测的有状态和无状态 LSTM

- 长短时记忆网络在时间序列预测中的适用性

- 时间序列预测问题的分类

- Python 中长短期记忆网络的时间序列预测

- 基于 Keras 的 Python 中 LSTM 循环神经网络的时间序列预测

- Keras 中深度学习的时间序列预测

- 如何用 Keras 调整 LSTM 超参数进行时间序列预测

- 如何在时间序列预测训练期间更新 LSTM 网络

- 如何使用 LSTM 网络的 Dropout 进行时间序列预测

- 如何使用 LSTM 网络中的特征进行时间序列预测

- 如何在 LSTM 网络中使用时间序列进行时间序列预测

- 如何利用 LSTM 网络进行权重正则化进行时间序列预测

- Machine Learning Mastery 线性代数教程

- 机器学习数学符号的基础知识

- 用 NumPy 阵列轻松介绍广播

- 如何从 Python 中的 Scratch 计算主成分分析(PCA)

- 用于编码器审查的计算线性代数

- 10 机器学习中的线性代数示例

- 线性代数的温和介绍

- 用 NumPy 轻松介绍 Python 中的 N 维数组

- 机器学习向量的温和介绍

- 如何在 Python 中为机器学习索引,切片和重塑 NumPy 数组

- 机器学习的矩阵和矩阵算法简介

- 温和地介绍机器学习的特征分解,特征值和特征向量

- NumPy 对预期价值,方差和协方差的简要介绍

- 机器学习矩阵分解的温和介绍

- 用 NumPy 轻松介绍机器学习的张量

- 用于机器学习的线性代数中的矩阵类型简介

- 用于机器学习的线性代数备忘单

- 线性代数的深度学习

- 用于机器学习的线性代数(7 天迷你课程)

- 机器学习的线性代数

- 机器学习矩阵运算的温和介绍

- 线性代数评论没有废话指南

- 学习机器学习线性代数的主要资源

- 浅谈机器学习的奇异值分解

- 如何用线性代数求解线性回归

- 用于机器学习的稀疏矩阵的温和介绍

- 机器学习中向量规范的温和介绍

- 学习线性代数用于机器学习的 5 个理由

- Machine Learning Mastery LSTM 教程

- Keras中长短期记忆模型的5步生命周期

- 长短时记忆循环神经网络的注意事项

- CNN长短期记忆网络

- 逆向神经网络中的深度学习速成课程

- 可变长度输入序列的数据准备

- 如何用Keras开发用于Python序列分类的双向LSTM

- 如何开发Keras序列到序列预测的编码器 - 解码器模型

- 如何诊断LSTM模型的过度拟合和欠拟合

- 如何开发一种编码器 - 解码器模型,注重Keras中的序列到序列预测

- 编码器 - 解码器长短期存储器网络

- 神经网络中爆炸梯度的温和介绍

- 对时间反向传播的温和介绍

- 生成长短期记忆网络的温和介绍

- 专家对长短期记忆网络的简要介绍

- 在序列预测问题上充分利用LSTM

- 编辑器 - 解码器循环神经网络全局注意的温和介绍

- 如何利用长短时记忆循环神经网络处理很长的序列

- 如何在Python中对一个热编码序列数据

- 如何使用编码器 - 解码器LSTM来回显随机整数序列

- 具有注意力的编码器 - 解码器RNN体系结构的实现模式

- 学习使用编码器解码器LSTM循环神经网络添加数字

- 如何学习长短时记忆循环神经网络回声随机整数

- 具有Keras的长短期记忆循环神经网络的迷你课程

- LSTM自动编码器的温和介绍

- 如何用Keras中的长短期记忆模型进行预测

- 用Python中的长短期内存网络演示内存

- 基于循环神经网络的序列预测模型的简要介绍

- 深度学习的循环神经网络算法之旅

- 如何重塑Keras中长短期存储网络的输入数据

- 了解Keras中LSTM的返回序列和返回状态之间的差异

- RNN展开的温和介绍

- 5学习LSTM循环神经网络的简单序列预测问题的例子

- 使用序列进行预测

- 堆叠长短期内存网络

- 什么是教师强制循环神经网络?

- 如何在Python中使用TimeDistributed Layer for Long Short-Term Memory Networks

- 如何准备Keras中截断反向传播的序列预测

- 如何在使用LSTM进行训练和预测时使用不同的批量大小

- Machine Learning Mastery 机器学习算法教程

- 机器学习算法之旅

- 用于机器学习的装袋和随机森林集合算法

- 从头开始实施机器学习算法的好处

- 更好的朴素贝叶斯:从朴素贝叶斯算法中获取最多的12个技巧

- 机器学习的提升和AdaBoost

- 选择机器学习算法:Microsoft Azure的经验教训

- 机器学习的分类和回归树

- 什么是机器学习中的混淆矩阵

- 如何使用Python从头开始创建算法测试工具

- 通过创建机器学习算法的目标列表来控制

- 从头开始停止编码机器学习算法

- 在实现机器学习算法时,不要从开源代码开始

- 不要使用随机猜测作为基线分类器

- 浅谈机器学习中的概念漂移

- 温和介绍机器学习中的偏差 - 方差权衡

- 机器学习的梯度下降

- 机器学习算法如何工作(他们学习输入到输出的映射)

- 如何建立机器学习算法的直觉

- 如何实现机器学习算法

- 如何研究机器学习算法行为

- 如何学习机器学习算法

- 如何研究机器学习算法

- 如何研究机器学习算法

- 如何在Python中从头开始实现反向传播算法

- 如何用Python从头开始实现Bagging

- 如何用Python从头开始实现基线机器学习算法

- 如何在Python中从头开始实现决策树算法

- 如何用Python从头开始实现学习向量量化

- 如何利用Python从头开始随机梯度下降实现线性回归

- 如何利用Python从头开始随机梯度下降实现Logistic回归

- 如何用Python从头开始实现机器学习算法表现指标

- 如何在Python中从头开始实现感知器算法

- 如何在Python中从零开始实现随机森林

- 如何在Python中从头开始实现重采样方法

- 如何用Python从头开始实现简单线性回归

- 如何用Python从头开始实现堆栈泛化(Stacking)

- K-Nearest Neighbors for Machine Learning

- 学习机器学习的向量量化

- 机器学习的线性判别分析

- 机器学习的线性回归

- 使用梯度下降进行机器学习的线性回归教程

- 如何在Python中从头开始加载机器学习数据

- 机器学习的Logistic回归

- 机器学习的Logistic回归教程

- 机器学习算法迷你课程

- 如何在Python中从头开始实现朴素贝叶斯

- 朴素贝叶斯机器学习

- 朴素贝叶斯机器学习教程

- 机器学习算法的过拟合和欠拟合

- 参数化和非参数机器学习算法

- 理解任何机器学习算法的6个问题

- 在机器学习中拥抱随机性

- 如何使用Python从头开始扩展机器学习数据

- 机器学习的简单线性回归教程

- 有监督和无监督的机器学习算法

- 用于机器学习的支持向量机

- 在没有数学背景的情况下理解机器学习算法的5种技术

- 最好的机器学习算法

- 教程从头开始在Python中实现k-Nearest Neighbors

- 通过从零开始实现它们来理解机器学习算法(以及绕过坏代码的策略)

- 使用随机森林:在121个数据集上测试179个分类器

- 为什么从零开始实现机器学习算法

- Machine Learning Mastery 机器学习入门教程

- 机器学习入门的四个步骤:初学者入门与实践的自上而下策略

- 你应该培养的 5 个机器学习领域

- 一种选择机器学习算法的数据驱动方法

- 机器学习中的分析与数值解

- 应用机器学习是一种精英政治

- 机器学习的基本概念

- 如何成为数据科学家

- 初学者如何在机器学习中弄错

- 机器学习的最佳编程语言

- 构建机器学习组合

- 机器学习中分类与回归的区别

- 评估自己作为数据科学家并利用结果建立惊人的数据科学团队

- 探索 Kaggle 大师的方法论和心态:对 Diogo Ferreira 的采访

- 扩展机器学习工具并展示掌握

- 通过寻找地标开始机器学习

- 温和地介绍预测建模

- 通过提供结果在机器学习中获得梦想的工作

- 如何开始机器学习:自学蓝图

- 开始并在机器学习方面取得进展

- 应用机器学习的 Hello World

- 初学者如何使用小型项目开始机器学习并在 Kaggle 上进行竞争

- 我如何开始机器学习? (简短版)

- 我是如何开始机器学习的

- 如何在机器学习中取得更好的成绩

- 如何从在银行工作到担任 Target 的高级数据科学家

- 如何学习任何机器学习工具

- 使用小型目标项目深入了解机器学习工具

- 获得付费申请机器学习

- 映射机器学习工具的景观

- 机器学习开发环境

- 机器学习金钱

- 程序员的机器学习

- 机器学习很有意思

- 机器学习是 Kaggle 比赛

- 机器学习现在很受欢迎

- 机器学习掌握方法

- 机器学习很重要

- 机器学习 Q& A:概念漂移,更好的结果和学习更快

- 缺乏自学机器学习的路线图

- 机器学习很重要

- 快速了解任何机器学习工具(即使您是初学者)

- 机器学习工具

- 找到你的机器学习部落

- 机器学习在一年

- 通过竞争一致的大师 Kaggle

- 5 程序员在机器学习中开始犯错误

- 哲学毕业生到机器学习从业者(Brian Thomas 采访)

- 机器学习入门的实用建议

- 实用机器学习问题

- 使用来自 UCI 机器学习库的数据集练习机器学习

- 使用秘籍的任何机器学习工具快速启动

- 程序员可以进入机器学习

- 程序员应该进入机器学习

- 项目焦点:Shashank Singh 的人脸识别

- 项目焦点:使用 Mahout 和 Konstantin Slisenko 进行堆栈交换群集

- 机器学习自学指南

- 4 个自学机器学习项目

- ÁlvaroLemos 如何在数据科学团队中获得机器学习实习

- 如何思考机器学习

- 现实世界机器学习问题之旅

- 有关机器学习的有用知识

- 如果我没有学位怎么办?

- 如果我不是一个优秀的程序员怎么办?

- 如果我不擅长数学怎么办?

- 为什么机器学习算法会处理以前从未见过的数据?

- 是什么阻碍了你的机器学习目标?

- 什么是机器学习?

- 机器学习适合哪里?

- 为什么要进入机器学习?

- 研究对您来说很重要的机器学习问题

- 你这样做是错的。为什么机器学习不必如此困难

- Machine Learning Mastery Sklearn 教程

- Scikit-Learn 的温和介绍:Python 机器学习库

- 使用 Python 管道和 scikit-learn 自动化机器学习工作流程

- 如何以及何时使用带有 scikit-learn 的校准分类模型

- 如何比较 Python 中的机器学习算法与 scikit-learn

- 用于机器学习开发人员的 Python 崩溃课程

- 用 scikit-learn 在 Python 中集成机器学习算法

- 使用重采样评估 Python 中机器学习算法的表现

- 使用 Scikit-Learn 在 Python 中进行特征选择

- Python 中机器学习的特征选择

- 如何使用 scikit-learn 在 Python 中生成测试数据集

- scikit-learn 中的机器学习算法秘籍

- 如何使用 Python 处理丢失的数据

- 如何开始使用 Python 进行机器学习

- 如何使用 Scikit-Learn 在 Python 中加载数据

- Python 中概率评分方法的简要介绍

- 如何用 Scikit-Learn 调整算法参数

- 如何在 Mac OS X 上安装 Python 3 环境以进行机器学习和深度学习

- 使用 scikit-learn 进行机器学习简介

- 从 shell 到一本带有 Fernando Perez 单一工具的书的 IPython

- 如何使用 Python 3 为机器学习开发创建 Linux 虚拟机

- 如何在 Python 中加载机器学习数据

- 您在 Python 中的第一个机器学习项目循序渐进

- 如何使用 scikit-learn 进行预测

- 用于评估 Python 中机器学习算法的度量标准

- 使用 Pandas 为 Python 中的机器学习准备数据

- 如何使用 Scikit-Learn 为 Python 机器学习准备数据

- 项目焦点:使用 Artem Yankov 在 Python 中进行事件推荐

- 用于机器学习的 Python 生态系统

- Python 是应用机器学习的成长平台

- Python 机器学习书籍

- Python 机器学习迷你课程

- 使用 Pandas 快速和肮脏的数据分析

- 使用 Scikit-Learn 重新调整 Python 中的机器学习数据

- 如何以及何时使用 ROC 曲线和精确调用曲线进行 Python 分类

- 使用 scikit-learn 在 Python 中保存和加载机器学习模型

- scikit-learn Cookbook 书评

- 如何使用 Anaconda 为机器学习和深度学习设置 Python 环境

- 使用 scikit-learn 在 Python 中进行 Spot-Check 分类机器学习算法

- 如何在 Python 中开发可重复使用的抽样检查算法框架

- 使用 scikit-learn 在 Python 中进行 Spot-Check 回归机器学习算法

- 使用 Python 中的描述性统计来了解您的机器学习数据

- 使用 OpenCV,Python 和模板匹配来播放“哪里是 Waldo?”

- 使用 Pandas 在 Python 中可视化机器学习数据

- Machine Learning Mastery 统计学教程

- 浅谈计算正态汇总统计量

- 非参数统计的温和介绍

- Python中常态测试的温和介绍

- 浅谈Bootstrap方法

- 浅谈机器学习的中心极限定理

- 浅谈机器学习中的大数定律

- 机器学习的所有统计数据

- 如何计算Python中机器学习结果的Bootstrap置信区间

- 浅谈机器学习的Chi-Squared测试

- 机器学习的置信区间

- 随机化在机器学习中解决混杂变量的作用

- 机器学习中的受控实验

- 机器学习统计学速成班

- 统计假设检验的关键值以及如何在Python中计算它们

- 如何在机器学习中谈论数据(统计学和计算机科学术语)

- Python中数据可视化方法的简要介绍

- Python中效果大小度量的温和介绍

- 估计随机机器学习算法的实验重复次数

- 机器学习评估统计的温和介绍

- 如何计算Python中的非参数秩相关性

- 如何在Python中计算数据的5位数摘要

- 如何在Python中从头开始编写学生t检验

- 如何在Python中生成随机数

- 如何转换数据以更好地拟合正态分布

- 如何使用相关来理解变量之间的关系

- 如何使用统计信息识别数据中的异常值

- 用于Python机器学习的随机数生成器简介

- k-fold交叉验证的温和介绍

- 如何计算McNemar的比较两种机器学习量词的测试

- Python中非参数统计显着性测试简介

- 如何在Python中使用参数统计显着性测试

- 机器学习的预测间隔

- 应用统计学与机器学习的密切关系

- 如何使用置信区间报告分类器表现

- 统计数据分布的简要介绍

- 15 Python中的统计假设检验(备忘单)

- 统计假设检验的温和介绍

- 10如何在机器学习项目中使用统计方法的示例

- Python中统计功效和功耗分析的简要介绍

- 统计抽样和重新抽样的简要介绍

- 比较机器学习算法的统计显着性检验

- 机器学习中统计容差区间的温和介绍

- 机器学习统计书籍

- 评估机器学习模型的统计数据

- 机器学习统计(7天迷你课程)

- 用于机器学习的简明英语统计

- 如何使用统计显着性检验来解释机器学习结果

- 什么是统计(为什么它在机器学习中很重要)?

- Machine Learning Mastery 时间序列入门教程

- 如何在 Python 中为时间序列预测创建 ARIMA 模型

- 用 Python 进行时间序列预测的自回归模型

- 如何回溯机器学习模型的时间序列预测

- Python 中基于时间序列数据的基本特征工程

- R 的时间序列预测热门书籍

- 10 挑战机器学习时间序列预测问题

- 如何将时间序列转换为 Python 中的监督学习问题

- 如何将时间序列数据分解为趋势和季节性

- 如何用 ARCH 和 GARCH 模拟波动率进行时间序列预测

- 如何将时间序列数据集与 Python 区分开来

- Python 中时间序列预测的指数平滑的温和介绍

- 用 Python 进行时间序列预测的特征选择

- 浅谈自相关和部分自相关

- 时间序列预测的 Box-Jenkins 方法简介

- 用 Python 简要介绍时间序列的时间序列预测

- 如何使用 Python 网格搜索 ARIMA 模型超参数

- 如何在 Python 中加载和探索时间序列数据

- 如何使用 Python 对 ARIMA 模型进行手动预测

- 如何用 Python 进行时间序列预测的预测

- 如何使用 Python 中的 ARIMA 进行样本外预测

- 如何利用 Python 模拟残差错误来纠正时间序列预测

- 使用 Python 进行数据准备,特征工程和时间序列预测的移动平均平滑

- 多步时间序列预测的 4 种策略

- 如何在 Python 中规范化和标准化时间序列数据

- 如何利用 Python 进行时间序列预测的基线预测

- 如何使用 Python 对时间序列预测数据进行功率变换

- 用于时间序列预测的 Python 环境

- 如何重构时间序列预测问题

- 如何使用 Python 重新采样和插值您的时间序列数据

- 用 Python 编写 SARIMA 时间序列预测

- 如何在 Python 中保存 ARIMA 时间序列预测模型

- 使用 Python 进行季节性持久性预测

- 基于 ARIMA 的 Python 历史规模敏感性预测技巧分析

- 简单的时间序列预测模型进行测试,这样你就不会欺骗自己

- 标准多变量,多步骤和多站点时间序列预测问题

- 如何使用 Python 检查时间序列数据是否是固定的

- 使用 Python 进行时间序列数据可视化

- 7 个机器学习的时间序列数据集

- 时间序列预测案例研究与 Python:波士顿每月武装抢劫案

- Python 的时间序列预测案例研究:巴尔的摩的年度用水量

- 使用 Python 进行时间序列预测研究:法国香槟的月销售额

- 使用 Python 的置信区间理解时间序列预测不确定性

- 11 Python 中的经典时间序列预测方法(备忘单)

- 使用 Python 进行时间序列预测表现测量

- 使用 Python 7 天迷你课程进行时间序列预测

- 时间序列预测作为监督学习

- 什么是时间序列预测?

- 如何使用 Python 识别和删除时间序列数据的季节性

- 如何在 Python 中使用和删除时间序列数据中的趋势信息

- 如何在 Python 中调整 ARIMA 参数

- 如何用 Python 可视化时间序列残差预测错误

- 白噪声时间序列与 Python

- 如何通过时间序列预测项目

- Machine Learning Mastery XGBoost 教程

- 通过在 Python 中使用 XGBoost 提前停止来避免过度拟合

- 如何在 Python 中调优 XGBoost 的多线程支持

- 如何配置梯度提升算法

- 在 Python 中使用 XGBoost 进行梯度提升的数据准备

- 如何使用 scikit-learn 在 Python 中开发您的第一个 XGBoost 模型

- 如何在 Python 中使用 XGBoost 评估梯度提升模型

- 在 Python 中使用 XGBoost 的特征重要性和特征选择

- 浅谈机器学习的梯度提升算法

- 应用机器学习的 XGBoost 简介

- 如何在 macOS 上为 Python 安装 XGBoost

- 如何在 Python 中使用 XGBoost 保存梯度提升模型

- 从梯度提升开始,比较 165 个数据集上的 13 种算法

- 在 Python 中使用 XGBoost 和 scikit-learn 进行随机梯度提升

- 如何使用 Amazon Web Services 在云中训练 XGBoost 模型

- 在 Python 中使用 XGBoost 调整梯度提升的学习率

- 如何在 Python 中使用 XGBoost 调整决策树的数量和大小

- 如何在 Python 中使用 XGBoost 可视化梯度提升决策树

- 在 Python 中开始使用 XGBoost 的 7 步迷你课程